Предисловие

О книге

Цель данной интернет-книги — обеспечить быстрое погружение в написание бекенд приложений на Rust для уже опытных программистов.

Сначала мы детально познакомимся с самим языком, потом мы рассмотрим стандартную утилиту для управления проектами — Cargo, после чего мы погрузимся в асинхронные возможности Rust, и, под конец, разберёмся как создавать бекенд приложения.

На кого расчитана книга

Данная книга ориентирована на разработчиков, которые уже умеют программировать на других языках, и хотят быстро “вкатиться” в Rust.

Основная целевая аудитория — back-end инженеры, которые пишут на таких языках как Java, C#, Python, Ruby или Go, и недовольны той производительностью или потреблением ресурсов, которые предлагает их язык.

Подразумевается, что читатель уже знаком с такими вещами как:

- целые числа и числа с плавающей запятой

- арифметические и логические операции

- основные конструкции в императивных языках программирования: if, for, switch, функции

- базовые структуры данных: массив, список, хеш-таблица, дерево

- базовые алгоритмы: сортировка, поиска

- организации памяти программы: стек, куча

- основы работы с консолью

- многопоточность и механизмы синхронизации

- HTTP протокол

- реляционные базы данных

- JSON формат

О материале

При написании книги, автор хотел максимально сэкономить время читателя, поэтому главы, где описываются общеизвестные понятия (такие как примитивные типы данных, переменные, условный оператор if и т.д.), намеренно написаны очень коротко и поверхностно. При этом весь специфичный для Rust материал описан подробно.

Книга пытается быть максимально близкой к программисту, поэтому изобилует англицизмами и профессиональным жаргоном.

Установка Rust

Для работы с Rust вам понадобятся как минимум:

- Rust тулчейн (компилятор, система сборки и т.д.) — для компиляции файлов с исходным кодом на Rust в объектные файлы (файлы с машинным кодом)

- Линкер (компоновщик) — для сборки множества объектных файлов в исполняемый файл программы

- Стандартная библиотека C

Необходимость стандартной библиотеки C обусловлена тем, что для операции выделения памяти, а также для некоторых операций копирования, Rust использует Сишные функции.

Сборка прикладной программы на Rust выглядит примерно так:

То есть при сборке финального исполняемого файла из скомпилированных модулей, линкеру должна быть доступна стандартная библиотека C.

Установка Rust тулчейна осуществляется при помощи официальной утилиты rustup, а установка линкера и стандартной библиотеки C варьируется от операционной системы и C++ тулчейна.

В следующих главах мы рассмотрим установку Rust и C++ тулчейна на Windows и Linux.

Установка на Windows

Как мы уже знаем, для разработки на Rust под Windows, кроме Rust тулчейна нам потребуется стандартная библиотека C и линкер. На данный момент, на выбор есть два варианта их установки:

- Установить Microsoft Visual C++, которая помимо всего прочего включает в себя и стандартную библиотеку C, и линкер.

- Установить MinGW — порт GCC под Windows, который в свою очередь содержит стандартную библиотеку C и линкер.

По умолчанию настоятельно рекомендуется использовать вариант с Visual C++.

Rustup

Для всех вариантов установки нам потребуется утилита rustup. Для Window, установщик rustup поставляется в виде исполняемого файла rustup-init.exe, который можно скачать с официального сайта https://rust-lang.org/tools/install/

или по прямой ссылке: https://static.rust-lang.org/rustup/dist/x86_64-pc-windows-gnu/rustup-init.exe

Пока что просто скачаем rustup-init.exe, но запускать его будем после установки C++ тулчейна.

Установка с Microsoft Visual C++

Если у вас еще не установлена Visual Studio.

1) Скачайте инсталлятор Visual Studio с https://visualstudio.microsoft.com/

Нам потребуется бесплатная версия Visual Studio Community.

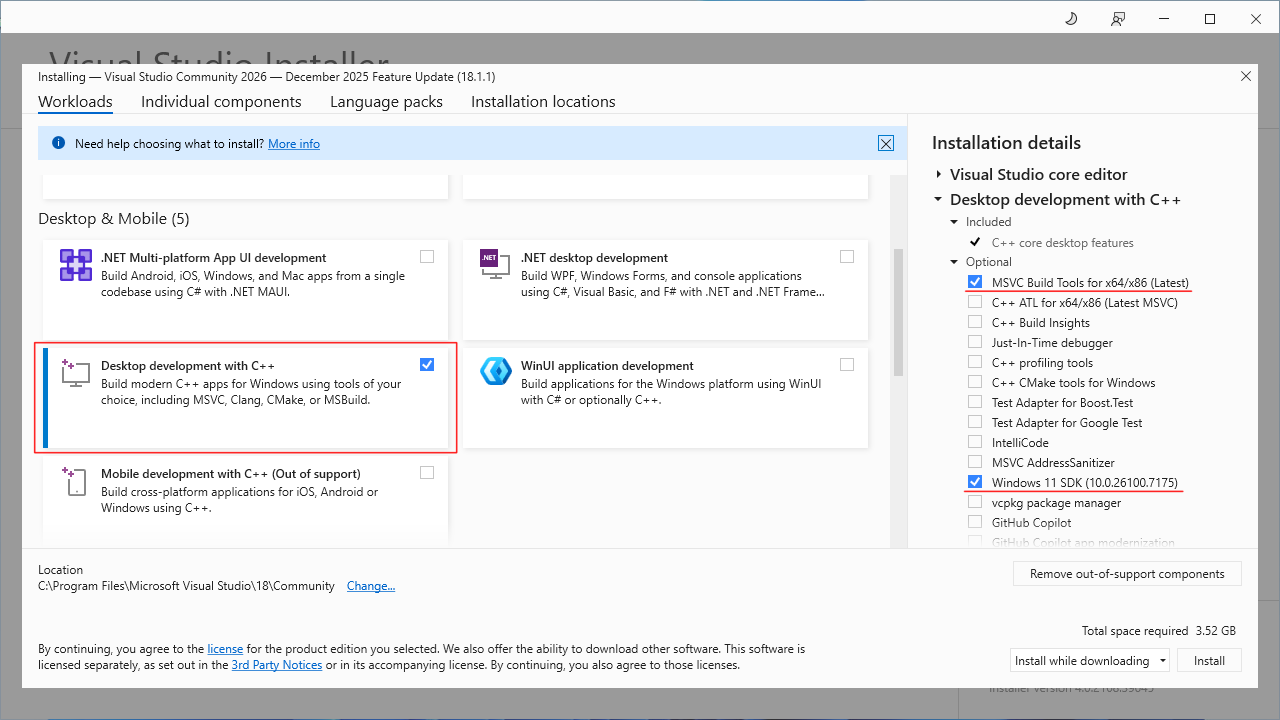

2) Запустите инсталятор, нажмите “Continue”, после чего вы должны увидеть окно выбора компонентов для установки.

Выберете категорию “Desktop development with C++”, и отметьте только компоненты

- MSVC Build Tools for x64/x86

- Windows 11 SDK

После, нажмите “Install”, и дождитесь завершения установки компонентов. После этого можно закрывать инсталятор.

Если у вас уже установлена Visual Studio, но отсутствуют компоненты MSVC Build Tools for x64/x86 и Windows 11 SDK, то просто запустите setup.exe, который находится в C:\Program Files (x86)\Microsoft Visual Studio\Installer\setup.exe, и доустановите их.

Note

Если вы не будете использовать библиотеки написанные на C/C++ (а в рамках этой книги мы не будем их использовать), то вам хватит только этих двух компонентов. Но в будущем вам могут понадобиться еще:

- C++ CMake tools for Windows — CMake утилита при помощи, которой собирается множество библиотек написанных на C++

- vcpkg package manager — утилита для установки библиотек на C/C++

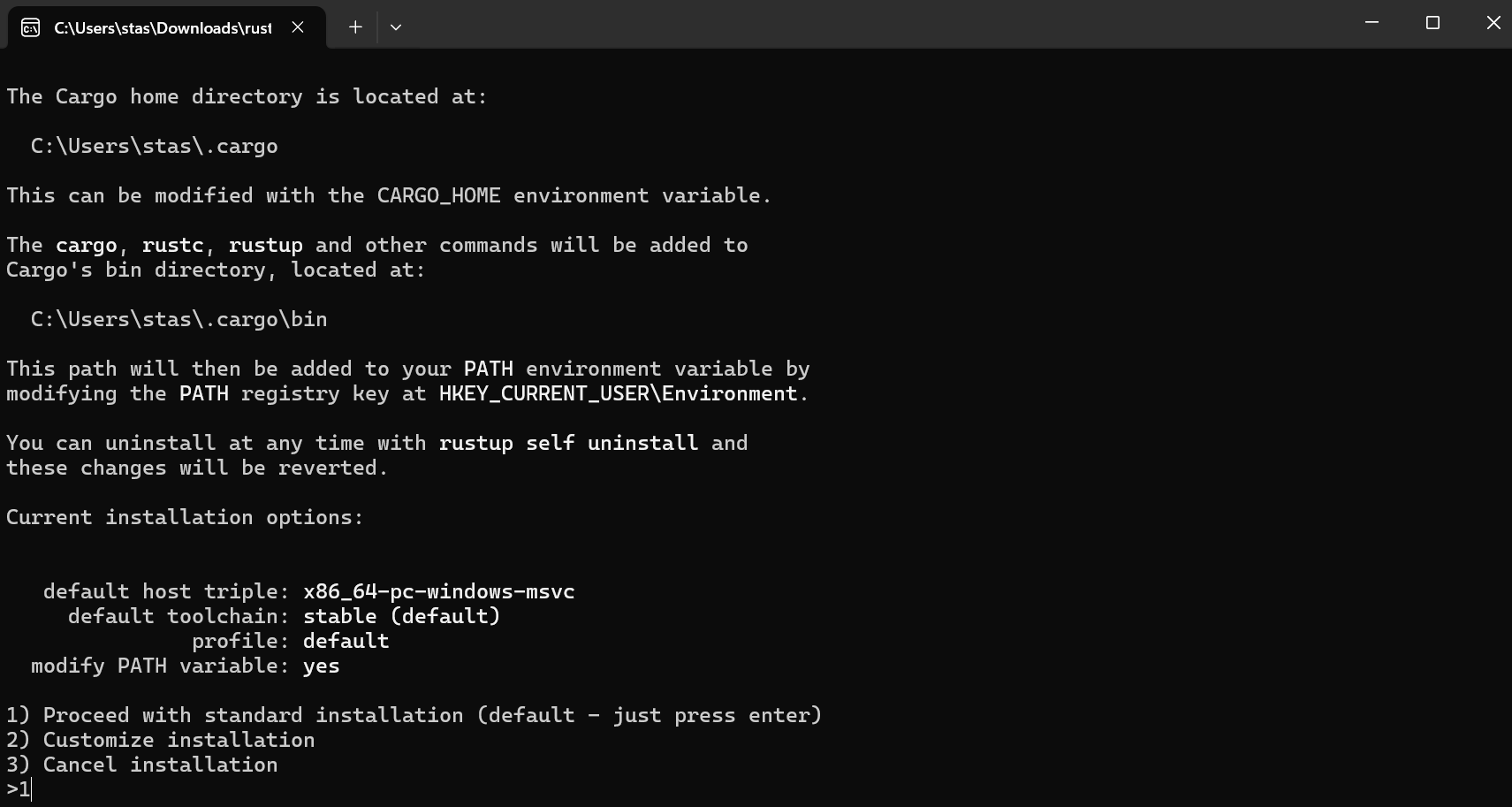

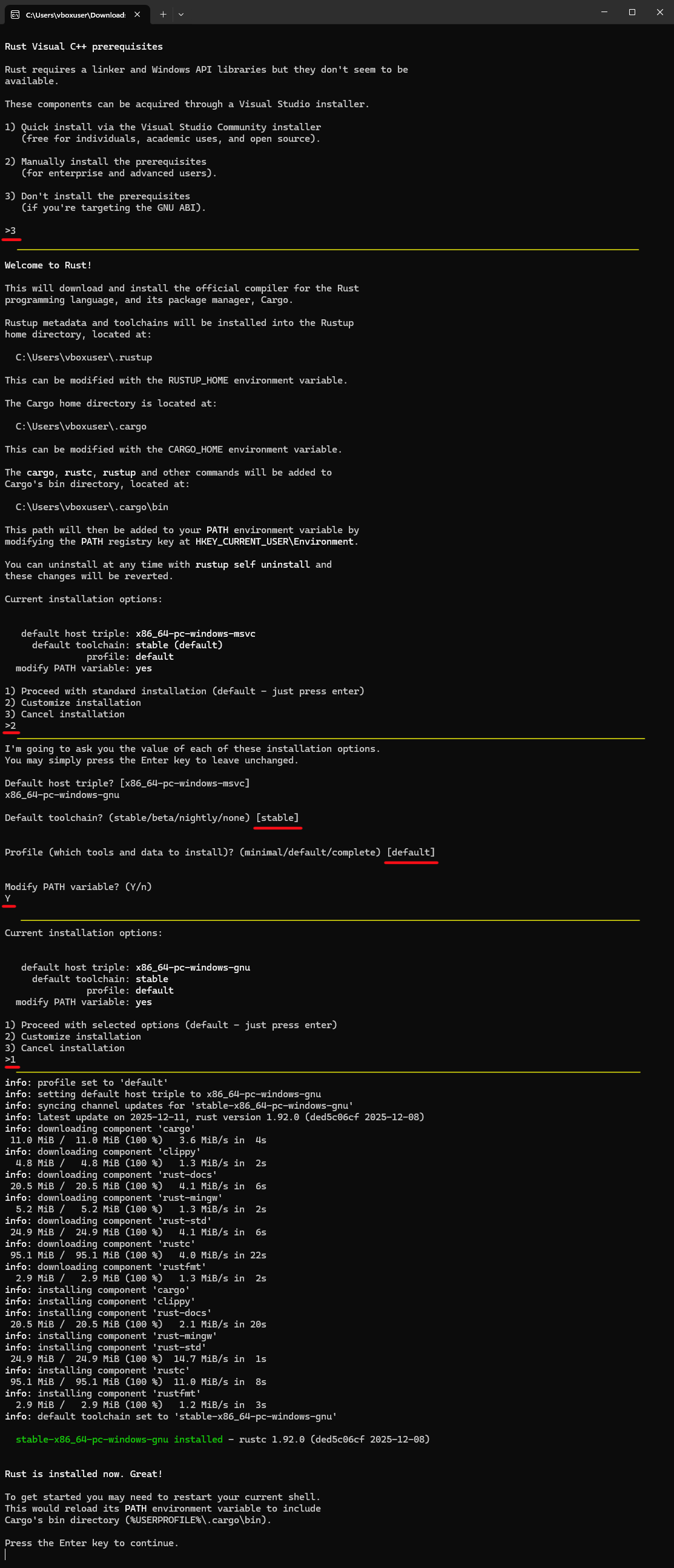

3) Теперь пришла очередь ранее скачанного rustup-init.exe. Запускаем инсталятор. Установщик по умолчанию предложит установить Rust тулчейн под target (целевую платформу) x86_64-pc-windows-msvc. Это как раз и есть сборка под Windows с использованием линкера и стандартной библиотеки от Visual C++. В консоли это должно выглядеть так:

Выбираем 1-й вариант (просто установить тулчейн с настройками по-умолчанию).

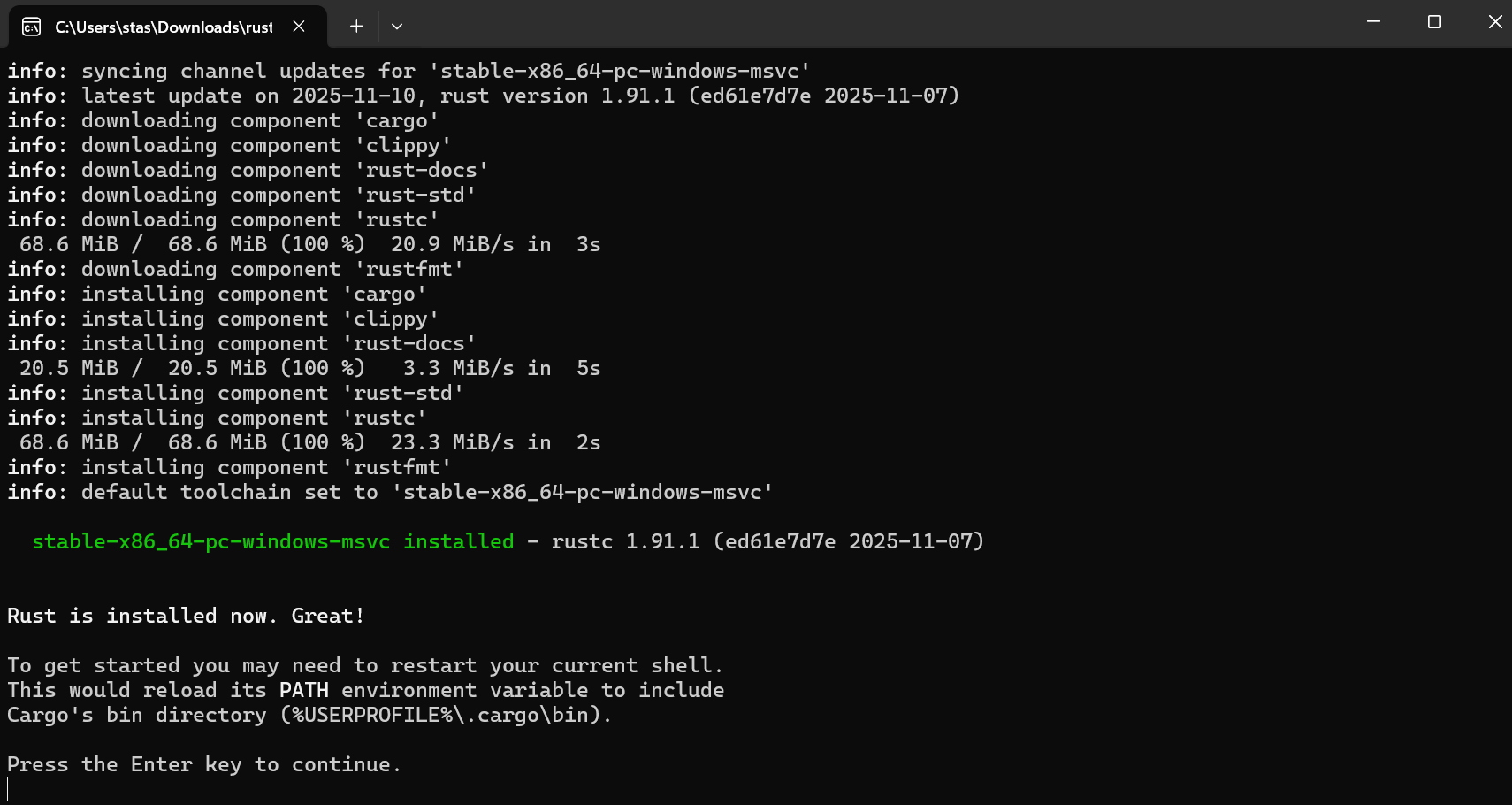

После установки компонентов Rust тулчейна, это окно консоли можно закрывать. Всё что нужно — установлено.

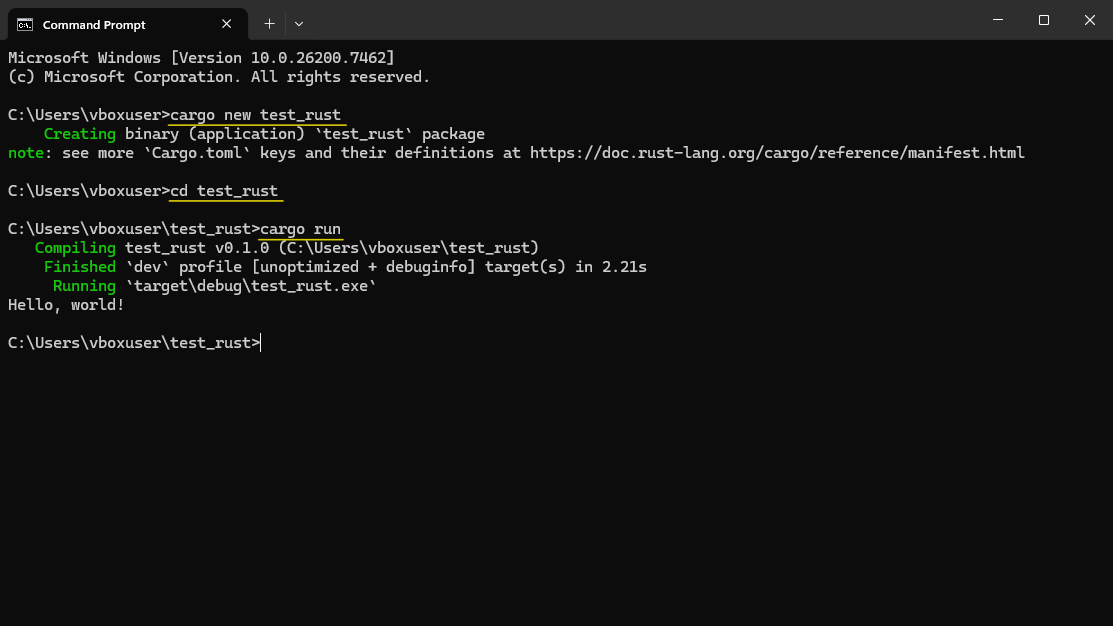

4) Теперь надо проверить, что компоненты установлены корректно.

Откройте консоль (PowerShell или cmd), и выполните следующие команды:

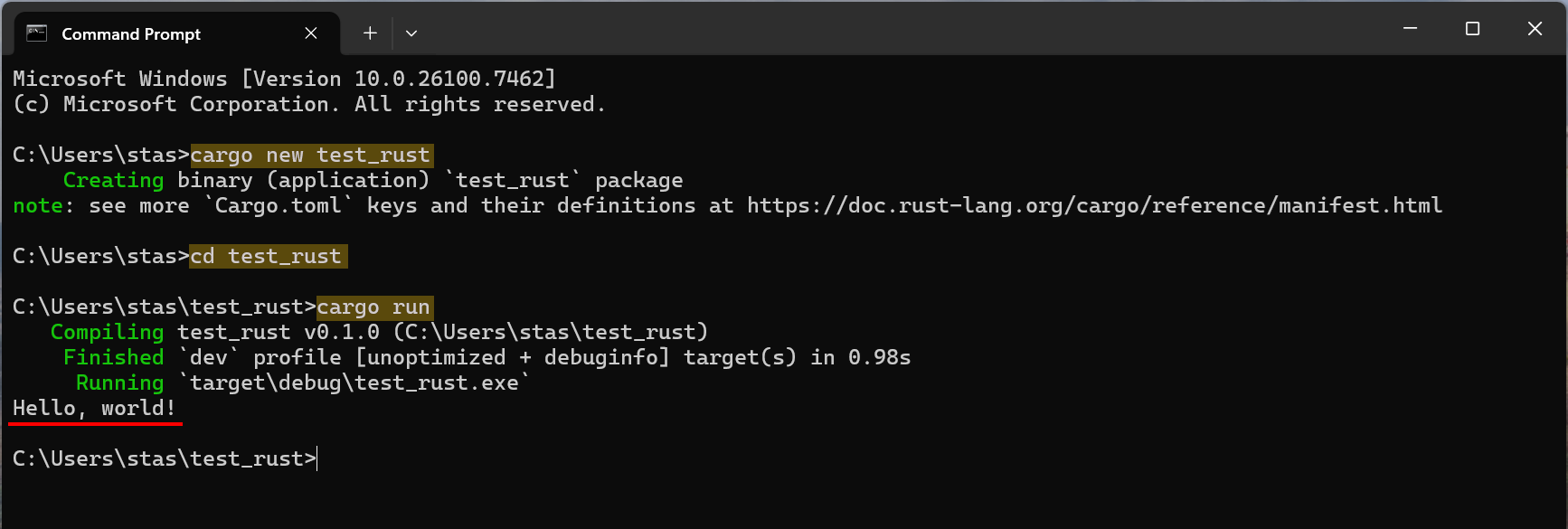

cargo new test_rust— создать новый Rust проект. С утилитой Cargo мы познакомимся потом, а пока что нам достаточно знать, что этой командой мы создадим “болванку” Rust программы, которая просто печатает на консоль строку “Hello, world!”cd test_rust— перейти в свежесозданный каталог test_rustcargo run— скомпилировать и запустить программу

В консоли это должно выглядеть так:

Всё готово.

Установка с MinGW

MinGW — порт компилятора GCC на Windows. Он так же содержит свой линкер и стандартную библиотеку C, поэтому может быть использован для сборки программ на Rust.

Существует несколько способов установки MinGW. Мы рассмотрим два из них:

- MinGW-W64-builds — просто архив с утилитами и библиотеками

- MSYS2 — среда для создания Linux-подобного окружения для разработки под Windows. Предлагает пакетный менеджер для простой установки утилит и библиотек, через который можно установить MinGW.

MinGW w64

Оригинальная сборка MinGW-w64 поставляется просто как архив, который можно скачать с официальной GitHub страницы: https://github.com/niXman/mingw-builds-binaries/releases.

На странице скачивания вы можетей найти несколько вариантов сборки, чьи имена составлены по схеме:

архитектура-версия-relese-АПИ_многопоточности-эксепшены-Си_рантайм-ревизия.7z

Например:

- x86_64-15.2.0-release-mcf-seh-ucrt-rt_v13-rev0.7z

- x86_64-15.2.0-release-posix-seh-msvcrt-rt_v13-rev0.7z

- x86_64-15.2.0-release-posix-seh-ucrt-rt_v13-rev0.7z

- x86_64-15.2.0-release-win32-seh-msvcrt-rt_v13-rev0.7z

- x86_64-15.2.0-release-win32-seh-ucrt-rt_v13-rev0.7z

Вам подойдёт любой вариант, кроме mcf, который не работал с Rust на момент написания этого текста (Rust 1.92). Лично автор предпочитает win32-seh-ucrt-rt вариант.

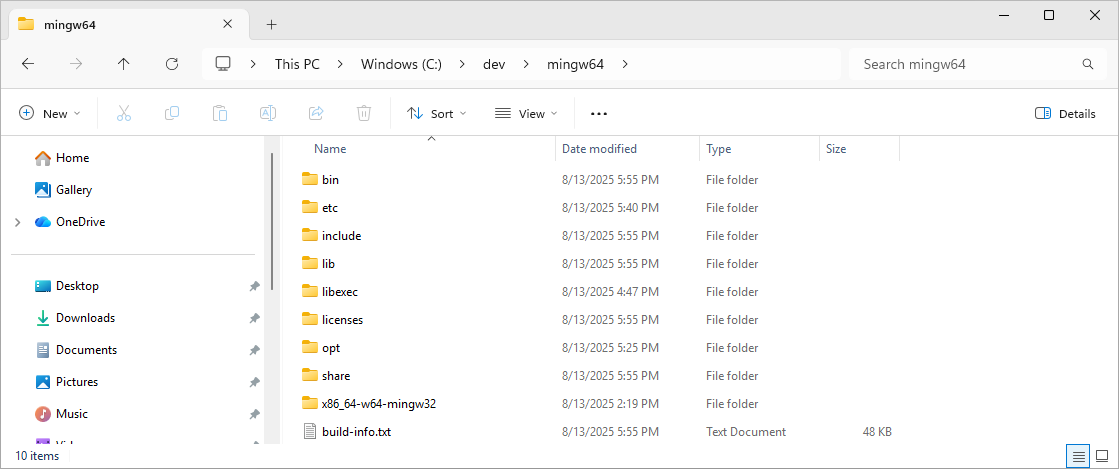

1) Скачайте 7z архив MinGW, и распакуйте в какую-то папку, например C:\dev\mingw64.

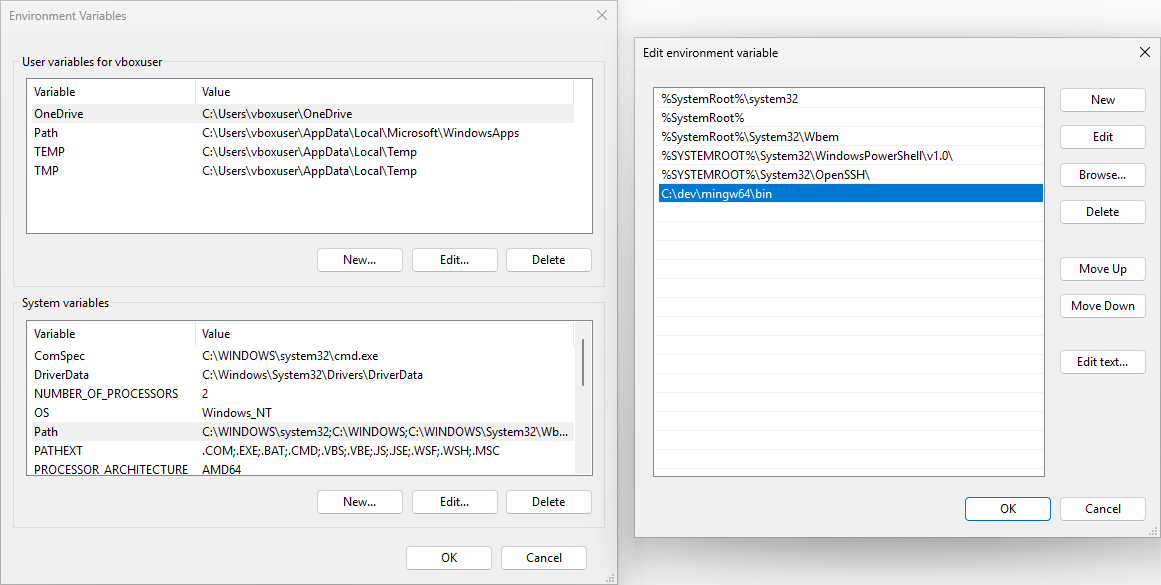

2) Добавте каталог mingw64\bin в системную переменную Path.

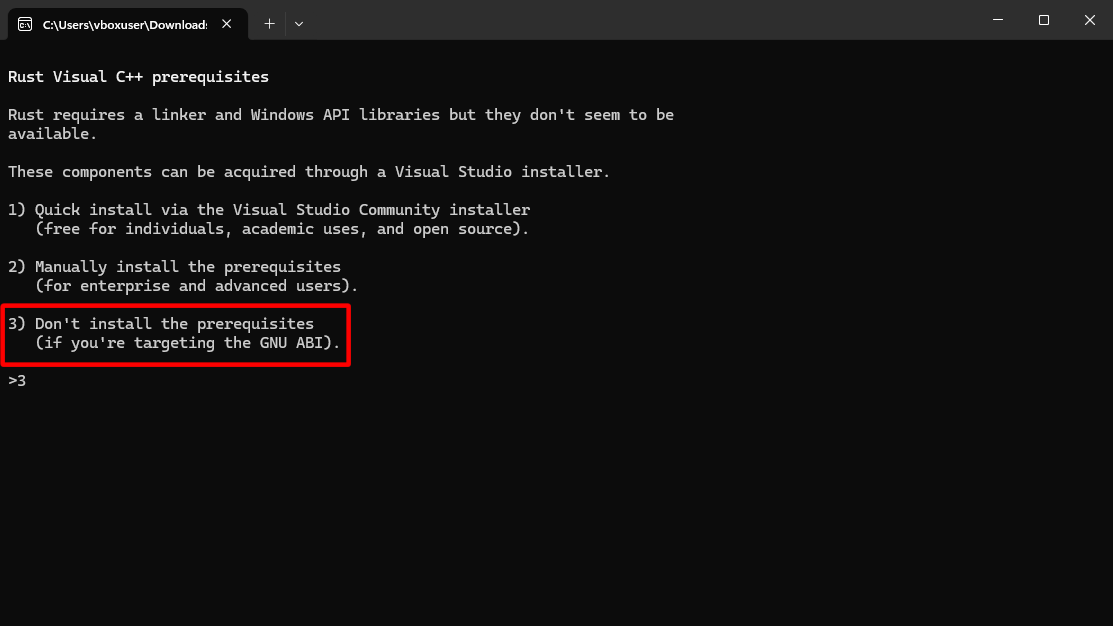

3) Теперь запустите rustup-init.exe.

На первый вопрос, который предлагает автоматическую установку компонентов, выберите пункт (3) — ничего не устанавливать.

Далее Rustup покажет конфигурацию, которую он предложит установить. По умолчанию это будет x86_64-pc-windows-msvc (тулчей и целевая платформа для Visual C++).

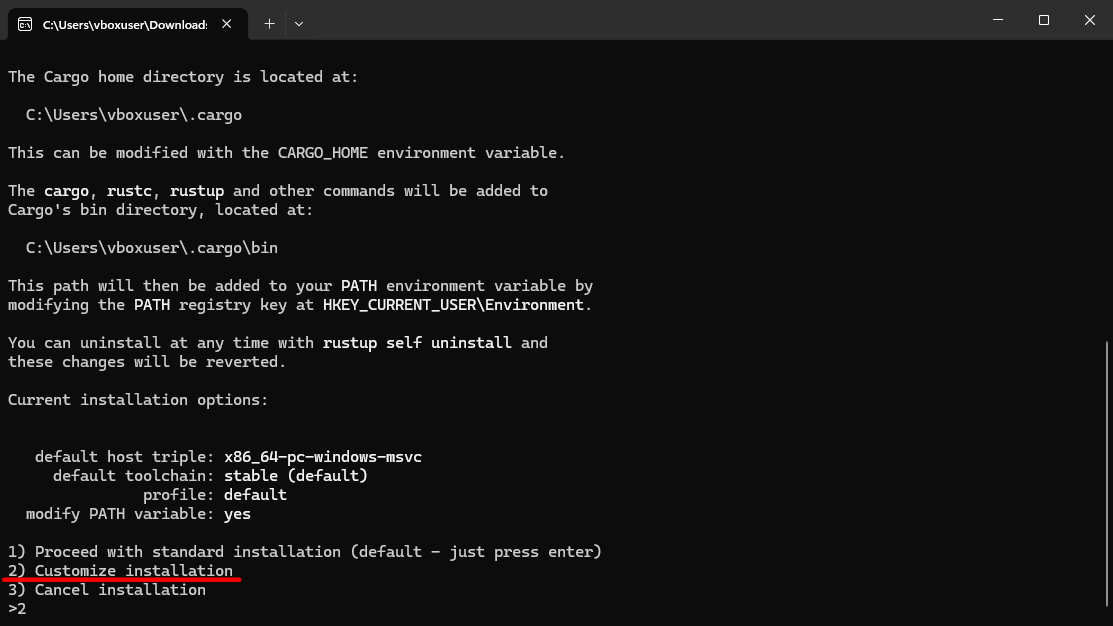

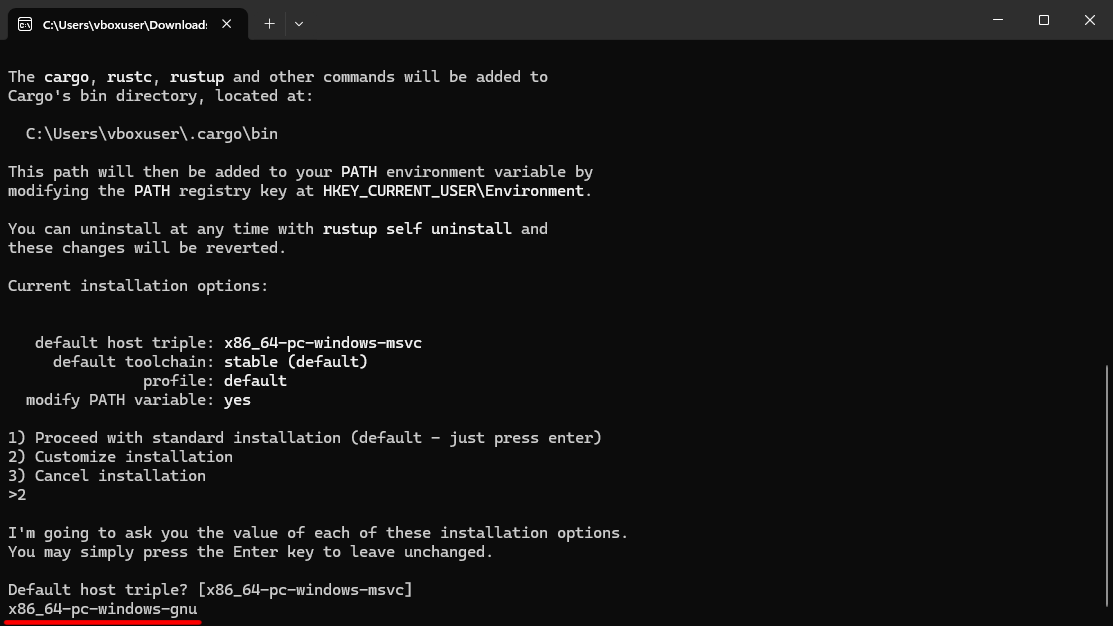

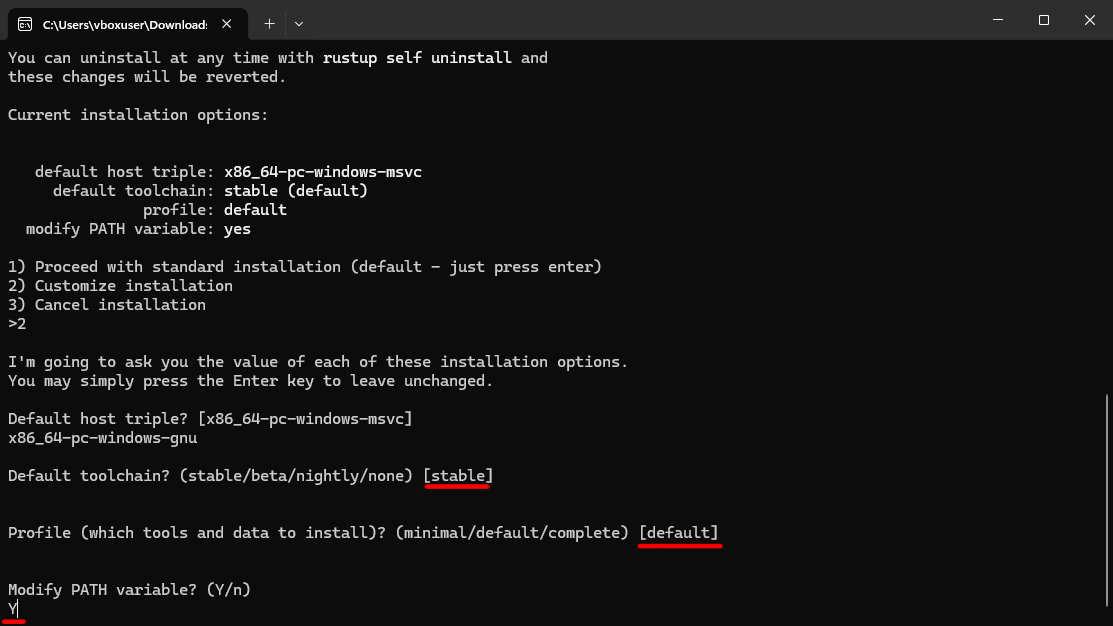

Выберити вариант (2) — кастомизировать конфигурацию.

Rustup попросит указать имя Rust тулчейна, который вы хотите установить. Вместо предлагаемого по умолчанию x86_64-pc-windows-msvc, укажите x86_64-pc-windows-gnu.

Для остальных параметров подходят значения по умолчанию.

Установка завершена. Теперь протестируем, что мы можем собрать программу на Rust.

Откройте новую консоль и создайте и запустите Hello World программу, таким же образом, как и в описании установки вместе с Visual C++.

cargo new test_rustcd test_rustcargo run

Результат должен выглядеть так:

MSYS2

Если в предыдущем сценарии с MinGW w64, мы вручную качали дистрибутив MinGW и самостоятельно добавляли его в системные пути, то при использовании MSYS2 всё будет куда более автоматизировано: MSYS2 предоставляет пакетный менеджер pacman, который умеет скачивать и устанавливать программы и библиотеки из удалённого репозитория. С его помощью мы и установим MinGW.

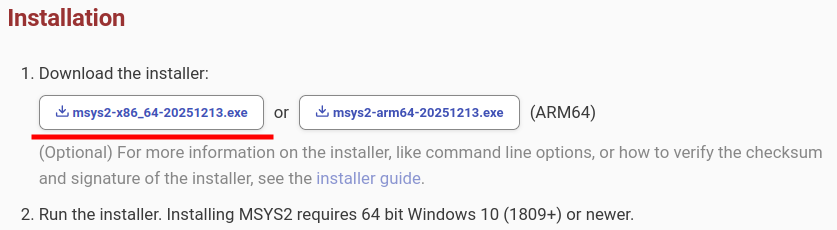

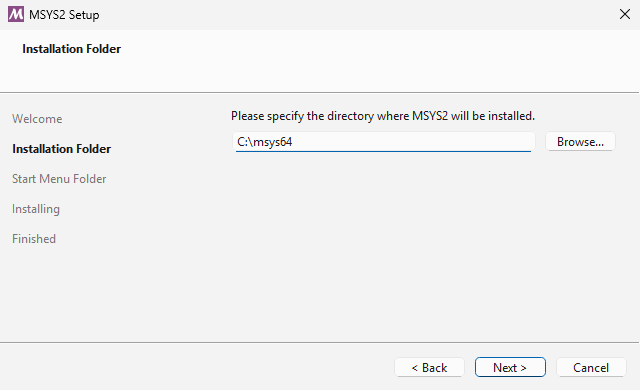

1) Сначала скачайте инсталлятор MSYS2: https://www.msys2.org/#installation

Запустите инсталлятор, и выберите путь по которому будет хранится как сам MSYS2, так и устанавливаемые им программы и библиотеки:

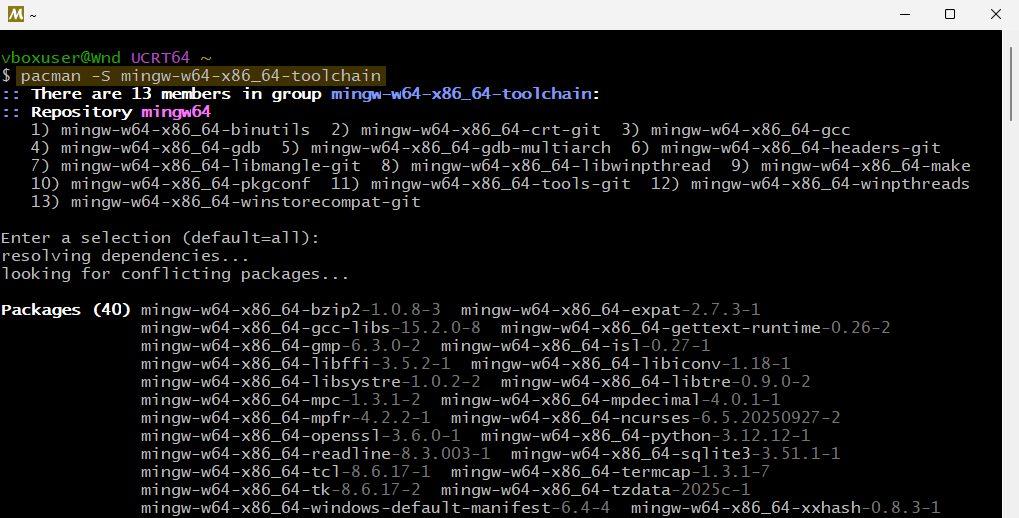

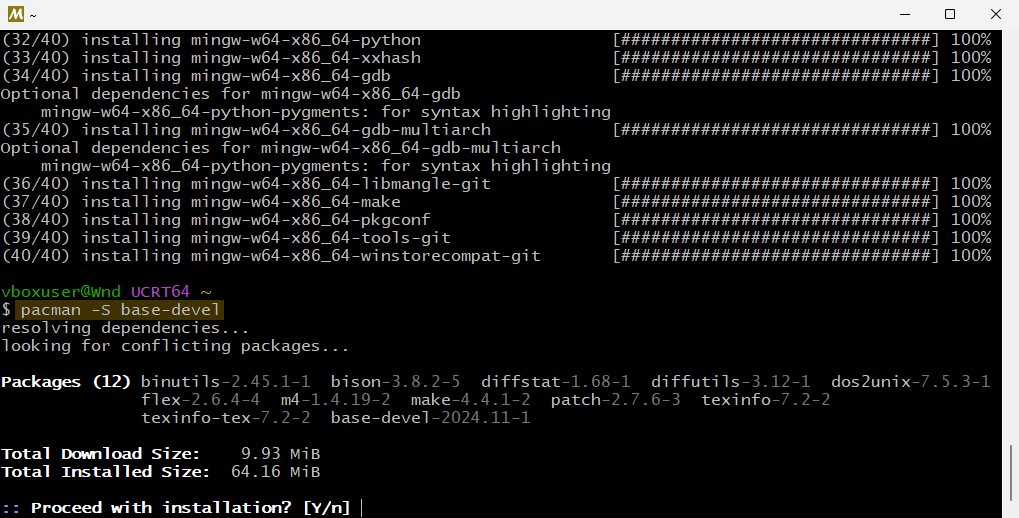

2) После завершения установки, откройте msys2 консоль (должна появится в меню “Пуск”) и установите пакеты mingw и base-develop при помощи команд:

pacman -S mingw-w64-x86_64-toolchain

pacman -S base-devel

Вот и всё: MinGW установлен и добавлен в системные пути.

Теперь осталось установить Rust тулчейн. Делается это точно таким же образом, как и для ручной установки MinGW w64.

3) Запустите rustup-init.exe.

Далее вместо x86_64-pc-windows-msvc выберите x86_64-pc-windows-gnu и завершите установку.

Установка Rust завершена. Теперь можно приступать к изучению самого языка.

Установка на Linux

Установка на Linux, как и установка на Windows, состоит из двух этапов:

- Установка C++ тулчейна

- Установка Rust тулчейна

Установка С++ тулчейна

В качестве C++ тулчейна мы будем использовать GCC.

В различных Linux дистрибутивах GCC устанавливается по-разному, но, как правило, при помощи пакетного менеджера.

В дистрибутивах Linux с пакетным менеджером apt (Ubuntu, Debian, Linux Mint), GCC устанавливается командой:

sudo apt install gcc

В дистрибутивах с пакетным менеджером yum и/или DNF (CentOS, Fedora, Oracle Linux) используется команда

sudo yum install gcc

или

sudo dnf install gcc

Установка Rust

После того как GCC установлен, мы должны установить утилиту rustup, которая управляет Rust окружением.

Для установки rustup выполните команду:

curl --proto '=https' --tlsv1.2 -sSf https://sh.rustup.rs | sh

Эта команда скачает и запустит скрипт rustup.sh, который, в свою очеред, скачает Rust тулчейн и поместит его в каталог ~/.rustup.

Tip

Если с установкой rustup возникли проблемы, то обратитесь к официальному руководству: https://www.rust-lang.org/tools/install

Выполните команду rustc --version, которая печатает версию текущего установленного компилятора Rust. Если всё прошло успешно, то вывод должен быть примерно таким:

$ rustc --version

rustc 1.89.0 (29483883e 2025-08-04)

Среда разработки

Кроме самого Rust тулчейна, вам, очевидно, понадобится редактор кода или среда разработки с поддержкой Rust. Популярные варианты:

- Rust Rover — очень мощная IDE от JetBrains специльно для Rust. Бесплатна для Open-Source разработки и обучения, но для коммерческий разработки придётся купить лицензию.

- VSCode — мощная, бесплатная и очень гибкая среда разработки с открытым исходным кодом.

- Zed — новая, бесплатная и очень быстрая среда разработки, написанная на Rust.

- NeoVim — мощный консольный редактор с высоким порогом входа, но большой гибкостью и расширяемостью. NeoVim — это форк оригинального Vim, в котором для написания плагинов вместо VimScript используется Lua.

- Helix — “клон” Vim, написанный на Rust. Не так гибок, как NeoVim, но дружественнее и проще.

Если вы уже пользуетесь одной из IDE от Jet Brains, при этом вам подходит как она сама, так и её лицензия и стоимость, то можете просто ставить Rust Rover и переходить к следующей главе.

rust-analyzer

Из всех вышеперечисленных сред разработки, только Rust Rover имеет собственную реализацию парсера и анализатора Rust кода. Все остальные работают с Rust кодом посредством rust-analyzer.

rust-analyzer — приложение, которое анализирует код на Rust и предоставляет такие возможности как:

- выведение типов

- автодополнение

- переход к объявлению переменной/функции/типа

- поиск всех использований функции/типа

- и т.д.

Редакторы кода взаимодействуют с rust-analyzer при помощи LSP (Language Server Protocol) — протокола, разработанного специально для взаимодейсвтия между редакторами и анализаторами кода.

Всё это значит, что перед тем как любой из вышеперечисленных редакторов сможет работать с Rust, вам необходимо установить rust-analyzer. Сделать это можно при помощи команды:

rustup component add rust-analyzer

После этого можно приступать к установке и настройке IDE.

VSCode

Если вы не работали со средами разработки от JetBrains или работали, но они вам не подходят, то первое, что рекомендуется попробовать — VSCode.

VSCode представляет из себя редактор кода, который изначально не умеет ничего кроме редактирования, но имеет обширную базу плагинов, способных легко превратить VSCode в мощную IDE.

Для начала скачайте VSCode с официального сайта: https://code.visualstudio.com/download. На сайте имеются варианты скачивания в виде :

- инсталлятора для Windows

- пакетов для Linux

- просто архива

Выбирайте то, что вам удобнее.

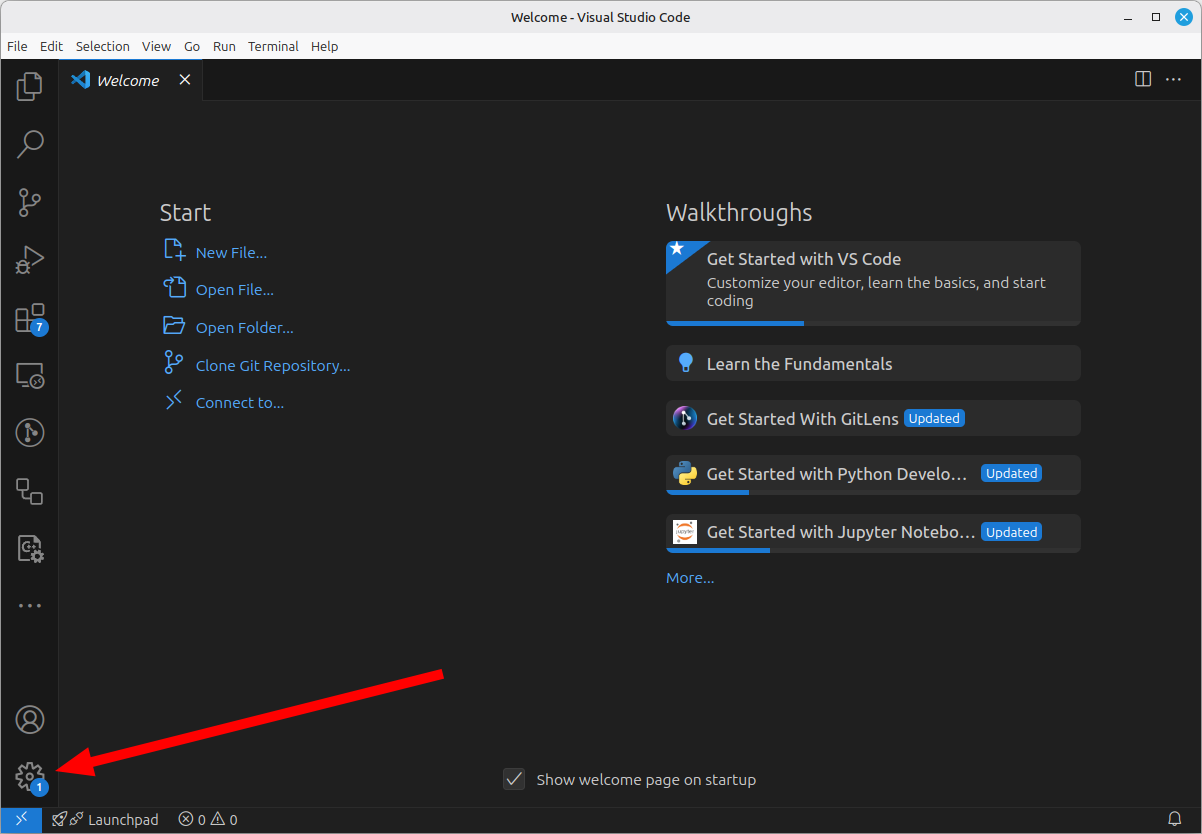

После скачивания, запустите VSCode и перейдите в плагины, щёлкнув на иконке как на изображении ниже:

В появившемся контекстном меню выберите пункт “Extension”, после чего перед вами должна открыться следующая панель:

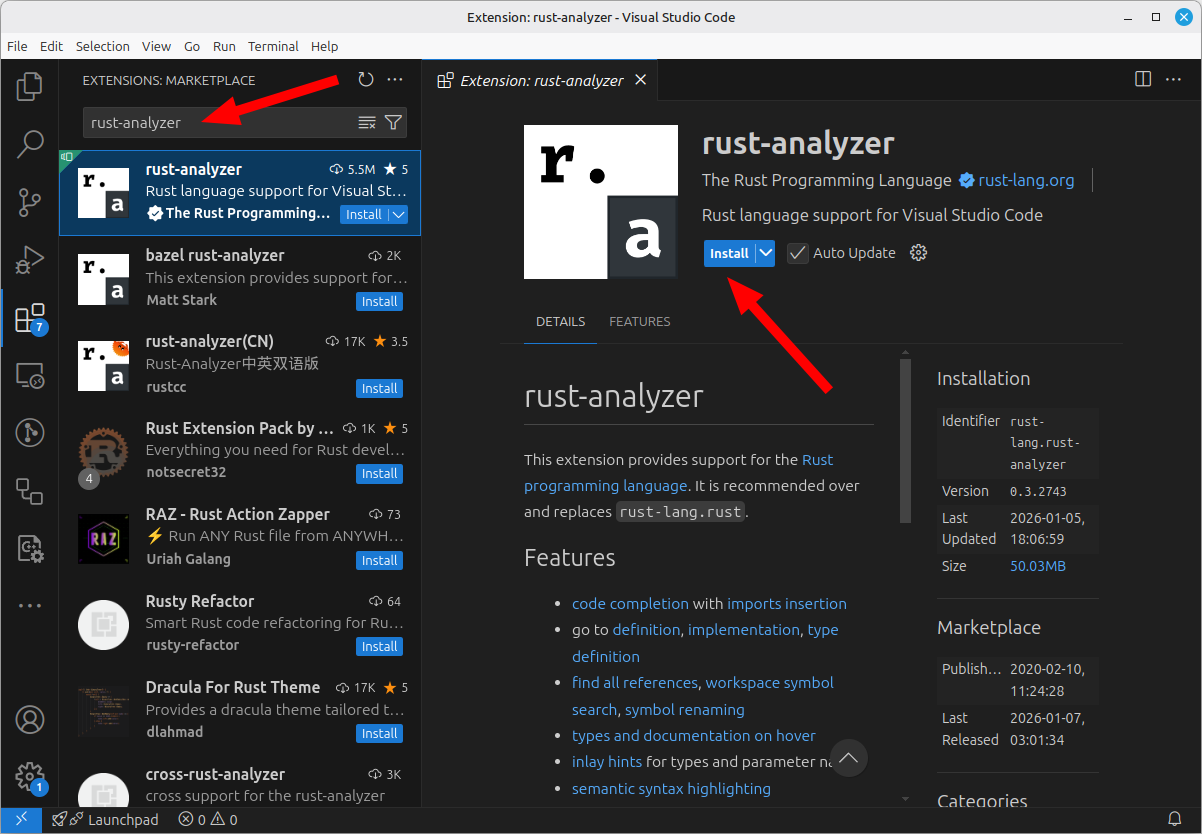

В левом верхнем углу находится поле ввода для поиска расширений. Введите в него “rust-analyzer”, и после того как расширение отобразится, нажмите “install”.

В принципе, этого уже достаточно, чтобы начать работать с Rust. Однако, рекомендуется так же установить следующие расширения:

- Even Better TOML — подсветка синтаксиса для TOML файлов

(ссылка на страницу плагина) - vscode-icons — более интуитивные пиктограммы в дереве файлов

(ссылка на страницу плагина)

После установки выберите в меню:

File -> Preferences -> Theme -> File Icon Theme -> VSCode Icons

Теперь протестируем, что всё работает.

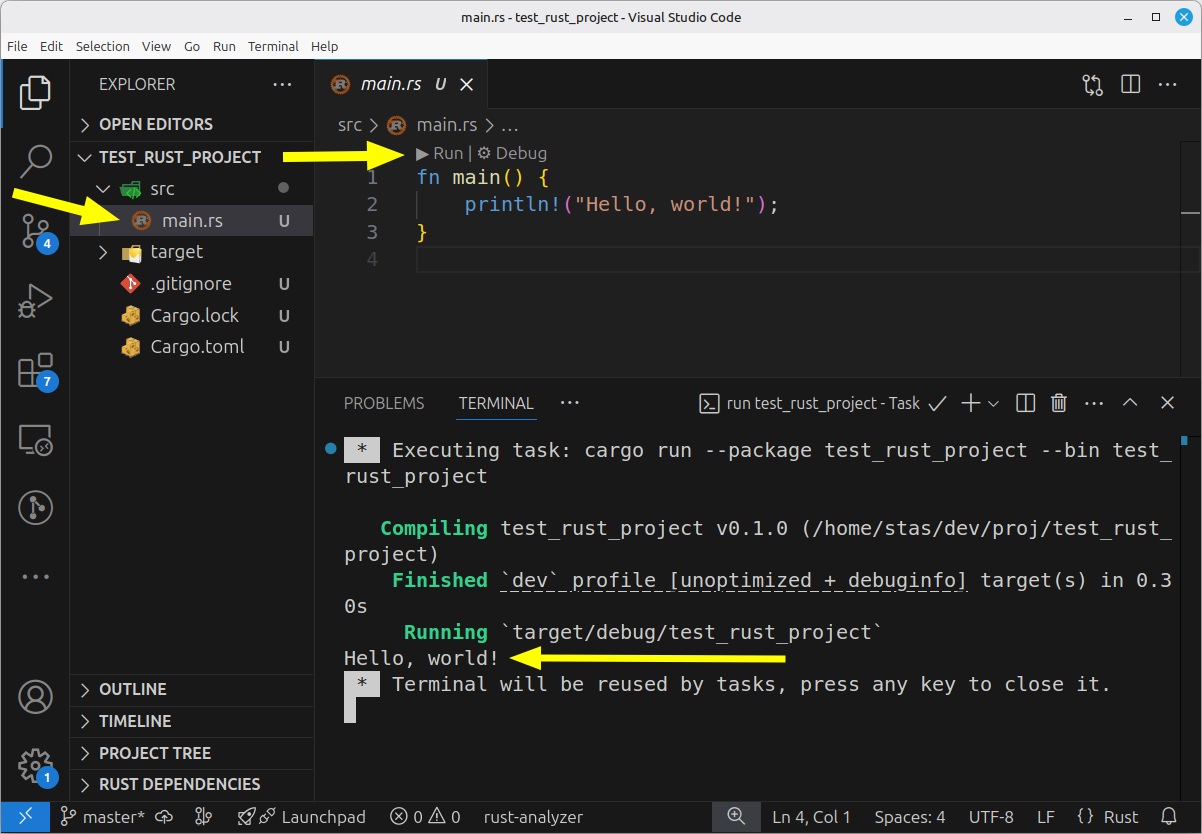

Создайте Rust проект: откройте консоль, перейдите в удобный каталог (командой cd) и выполните следующую команду:

cargo new test_rust_project

Эта команда создаст новую директорию test_rust_project с проектом.

В VSCode выберите в меню “File -> Open Folder” и укажите папку test_rust_project.

После этого должен открыться ваш свежесозданный проект. Слева в дереве файлов щёлкните на src/main.rs, после чего справа в редакторе кода появится содержимое файла.

Над главной функцией (fn main) должна отображаться стрелочка с надписью “Run”.

Нажмите на “Run”. Если после этого в нижней части окна появится терминал, в котором отобразится строка “Hello, World!”, то значит всё настроено верно.

Zed

Zed — молодая (первый бета релиз в 2023-м году) среда разработки, написанная на Rust и WGPU (библиотека для кроссплатформенной работы с графикой на GPU).

Основным фокусом Zed является производительность и эффективное использование аппаратных ресурсов. Если вы чувствительны к задержкам в работе графических приложений, то обязательно попробуйте Zed.

Скачать Zed можно с официального сайта: https://zed.dev/download

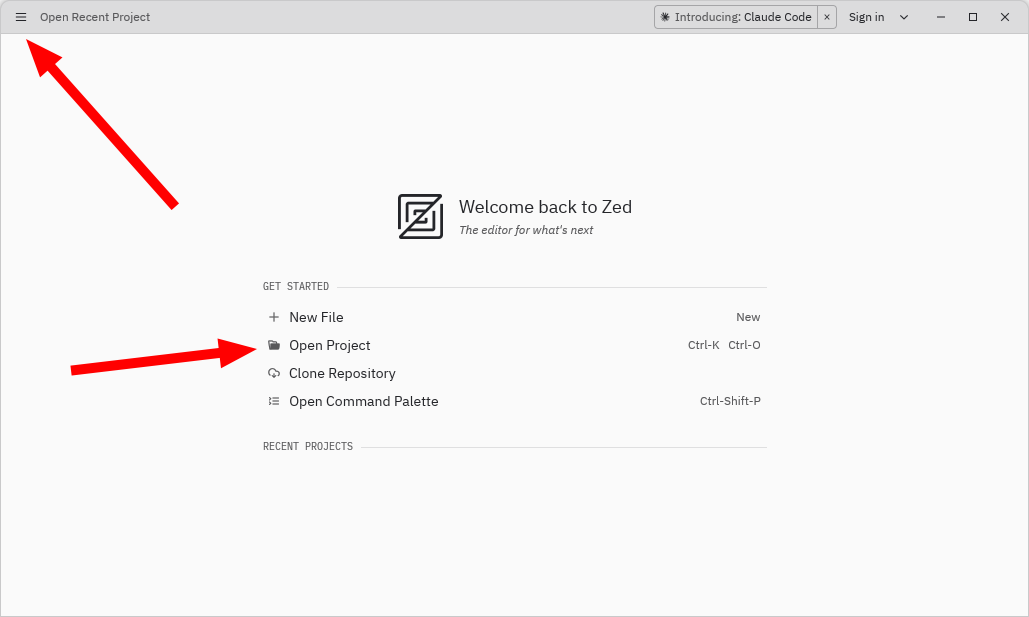

После запуска Zed выглядит так (разумеется, тёмная тема тоже имеется):

Zed сразу умеет общаться с rust-analyzer, поэтому никаких дополнительных расширений устанавливать не нужно.

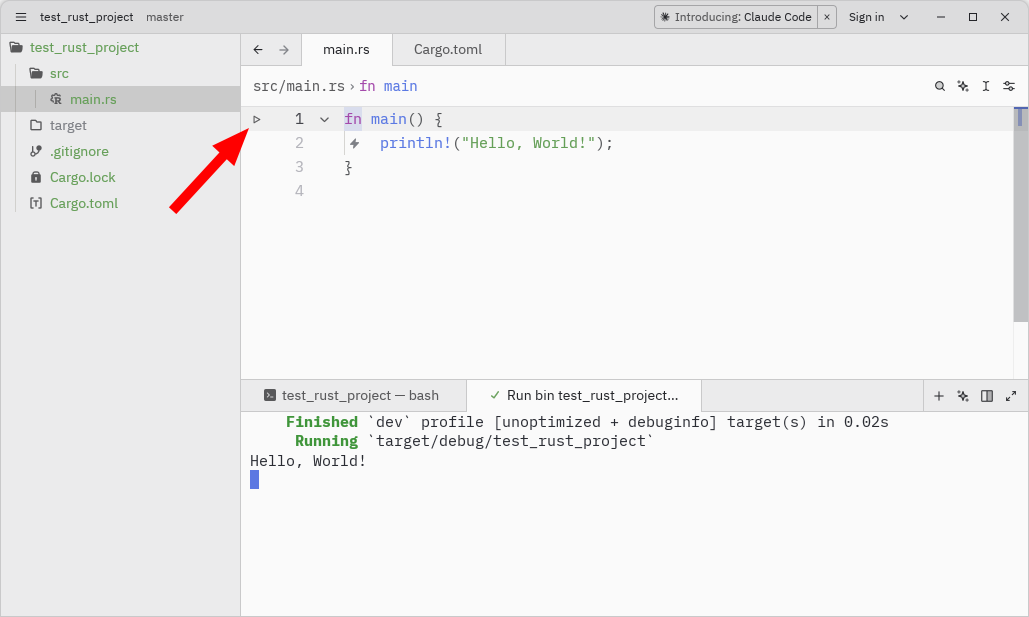

Создайте тестовый Rust проект: откройте консоль, перейдите в удобный каталог (командой cd) и выполните следующую команду:

cargo new test_rust_project

Теперь в Zed откройте папку со свежесозданным проектом. Для этого либо на панели в центре выберите “Open Project”, либо кликните на значок ≡, находящийся в левом верхнем углу, и выберите File -> Open Folder.

В дереве файлов проекта в левой части окна выберите файл src/main.rs, и в панели справа должно отобразиться содержимое файла.

Слева от функции main должен отображаться знак запуска — ▶. Нажмите на него, и в консоли снизу должен отобразиться вывод программы: Hello, World!

NeoVim

Если вы являетесь пользователем NeoVim, то вы и так уже всё знаете 😉

Если вы хотите попробовать Vim, но вас пугает перспектива его настройки, то попробуйте Helix.

Первый взгляд

Для начала, чтобы заложить фундамент нашего представления о языке, давайте посмотрим, как выглядит “Hello World” на Rust.

// Это комментарий

fn main() {

println!("Hello world!");

}Как видите, Rust — это язык с так называемым Си-подобным синтаксисом: тело функции обрамлено фигурными скобками, а каждое выражение заканчивается точкой с запятой.

Как и во многих Си-подобных языках, функция main — главная функция, с выполнения которой начинается программа.

Давайте скомпилируем эту программу.

1) Сохраните текст программы в файл main.rs в удобную для вас директорию.

2) Откройте консоль и перейдите (командой cd) в директорию, в которой находится файл main.rs

3) Скомпилируйте main.rs при помощи компилятора Rust — rustc:

rustc main.rs

Компилятор должен сгенерировать исполняемый файл: main.exe — на Windows или main — на Linux.

4) Запустите программу

На Linux:

./main

Hello world!

На Windows:

main

Hello world!

Безопасный Rust

Перед тем как мы погрузимся в изучение языковых конструкций, нужно сказать, что в языке Rust есть два подмножества: безопасный Rust и небезопасный.

По умолчанию мы пишем код на безопасном Rust, и компилятор гарантированно защищает нас от таких вещей, как:

- утечки памяти (memory leak)

- порча данных ввиду множественного доступа (concurrent modification errors)

- гонка за данные в многопоточной среде (data race)

- ошибки сегментации / ошибки доступа по нулевому указателю (segmentation error)

- неопределённое поведение (undefined behavior)

За такие гарантии безопасности мы платим определённой долей свободы, а именно в безопасном Rust коде запрещён ряд операций, таких как:

- работа с памятью при помощи указателя

- вызов кода из библиотек, написанных не на Rust

- работа с потенциально несинхронизированными данными

Такие операции относятся к небезопасному подмножеству Rust и могут быть выполнены только внутри специального unsafe блока.

Сразу хочется вас успокоить: при написании back-end приложений (а это основной фокус книги), использовать небезопасный Rust приходится крайне редко. В большинстве приложений можно полностью избежать использования небезопасного Rust.

В процессе изучения мы иногда будем отмечать, что какое-то действие доступно только в небезопасном Rust, и вы сами сможете убедиться, насколько редки эти случаи.

Переменные

Объявление переменной

Синтаксис для объявления переменных в Rust выглядит так:

let имя_переменной: тип = значение;Например:

#![allow(unused)]

fn main() {

let a: i32 = 5;

}Если при объявлении переменной ей сразу присваивается значение, то тип можно опустить, так как компилятор выведет его автоматически:

#![allow(unused)]

fn main() {

let a = 5;

}Также переменную можно сначала объявить, а значение присвоить ниже. При этом явное указание типа переменной так же не обязательно, так как компилятор сможет сопоставить объявление и последующую инициализацию.

#![allow(unused)]

fn main() {

let a;

a = 5;

}Мутабельность

Tip

Мутабельность — англицизм (mutable), который означает “изменяемость”.

По умолчанию переменные в Rust немутабельны, то есть после того, как переменной присвоено значение, другое значение в неё записать компилятор уже не позволит.

Такая программа:

fn main() {

let a = 1;

a = 5;

}вызовет ошибку компиляции:

error[E0384]: cannot assign twice to immutable variable `a`

--> main.rs:3:5

|

2 | let a = 1;

| - first assignment to `a`

3 | a = 5;

| ^^^^^ cannot assign twice to immutable variable

Для того, чтобы сделать переменную мутабельной, её нужно объявить с ключевым словом mut.

#![allow(unused)]

fn main() {

let mut a = 1;

a = 5;

}Именование переменных

Имена переменных могут содержать только буквы (включая допустимые Unicode буквы), цифры и символ подчёркивания. При этом имя переменной не может начинаться с цифры. Ключевые слова Rust не могут быть использованы в качестве имени переменной.

#![allow(unused)]

fn main() {

let a = 1;

let b_x_5 = 2;

let таки_переменная = 3;

let 変数名 = 4;

}В Rust для имен переменных принято использовать так называемую змеиную нотацию (Snake case):

- имена переменных должны начинаться со строчной буквы

- если имя переменной состоит из нескольких слов, то эти слова разделяются символом подчёркивания

Например:

#![allow(unused)]

fn main() {

let number = 1;

let some_number = 2;

let coordinate_2d_x = 2.11;

}В случае необходимости использовать ключевое слово в качестве имени переменной (такое может понадобиться, например, для десериализации поля из бинарного формата), необходимо к имени переменной добавить суффикс r#:

#![allow(unused)]

fn main() {

let r#if = 5;

}Константы

Кроме переменных, в Rust существуют и константы. В то время как переменные хранятся на стеке, константы хранятся, как правило, в сегменте кода.

Синтаксис объявления константы:

#![allow(unused)]

fn main() {

const ИМЯ: Тип = значение;

}В отличие от переменных, для констант всегда необходимо явно указывать тип данных.

Имена констант должны состоять из заглавных букв, а в качестве разделителя использовать знак подчёркивания.

#![allow(unused)]

fn main() {

const PI: f32 = 3.14;

const ANONYMOUS_NAME: &str = "anonymous";

}static

Статические переменные создаются в самом начале работы программы и существуют до её завершения, однако в отличие от констант, статические переменные:

- инициализируются уже во время работы программы, а не на этапе компиляции

- могут быть мутабельными

- могут содержать объекты, хранящие данные в куче

Статическая переменная объявляется при помощи ключевого слова static:

#![allow(unused)]

fn main() {

static ИМЯ: Тип = значение;

}Статические переменные могут быть как глобальными, так и локальными для функции. Оба вида мы отдельно разберём в соответствующих главах.

Мутабельная статическая переменная — потенциально небезопасный ресурс, так как она может быть одновременно изменена из нескольких потоков. Поэтому работа с мутабельными статическими данными — unsafe операция, о чём мы еще поговорим позже.

Note

В то время как константы, как правило, хранятся в сегмента кода, статические переменные хранятся в сегменте bss (Block Started by Symbol) или в сегменте данных.

Префикс _

Компилятор выдает предупреждения (warning) для каждой неиспользуемой переменной — переменной, которая объявлена и, возможно, инициализирована, но при этом не используется в каком-либо выражении.

Если мы намеренно хотим иметь в коде такую переменную (например, как задел для будущей функциональности), то мы можем начать имя переменной со знака подчёркивания.

Например:

#![allow(unused)]

fn main() {

let _some_unused_variable = 5;

}Компилятор не будет выдавать предупреждений о том, что такая переменная не используется.

“выброшенные” переменные

Если переменная состоит из одного только символа подчёркивания _, то она является “выброшенной” (discarded). Такая переменная семантически существует, однако обратиться к ней никак нельзя.

#![allow(unused)]

fn main() {

let _ = 5;

}Один из сценариев применения “выброшенных” переменных — сознательное игнорирование результата функции. Мы рассмотрим этот пример в главе Result

Также мы увидим применение таких переменных в главах Деструктурирующее присваивание и Паттерн матчинг.

Примитивные типы данных

В языке Rust имеются такие примитивные типы данных.

Целочисленные типы

| Размер | Знаковый | Беззнаковый |

|---|---|---|

| 8 бит | i8 | u8 |

| 16 бит | i16 | u16 |

| 32 бита | i32 | u32 |

| 64 бита | i64 | u64 |

| 128 бит | i128 | u128 |

| Платформозависимый (равный размеру указателя) | isize | usize |

Если мы объявляем переменную без указания типа и инициализируем её целым числом, то по умолчанию используется тип i32. Если же мы инициализируем переменную числом с плавающей запятой, то по умолчанию используется тип f64.

#![allow(unused)]

fn main() {

let a = 5; // i32

let b = 5.0; // f64

}Тип числа можно указывать как явно, так и при помощи суффикса к инициализирующему значению:

#![allow(unused)]

fn main() {

let a: u8 = 5;

let b = 5u8;

let c: f32 = 5.0;

let d = 5.0f32;

let e: u128 = 1;

let f = 1u128;

}Числа с плавающей запятой

Для представления чисел с плавающей запятой в Rust имеется два типа: f32 и f64. Соответственно, их размер 32 и 64 бита.

Оба типа реализуют стандарт IEEE-754, то есть значения типов f32 и f64 могут хранить как вещественные числа, так и “бесконечность” и “не число”.

#![allow(unused)]

fn main() {

let a: f32 = -1.0; // 1.0

let b = 5.0f32; // 5.0

let c = a + b; // 4.0

let d = 1.0 / 0.0; // inf

let e = a.sqrt(); // NaN

}bool

Булевый тип в Rust ровно такой, каким его можно ожидать: может хранить либо true, либо false.

#![allow(unused)]

fn main() {

let a: bool = true;

let b = false;

}Значение типа bool занимает в оперативной памяти 1 байт.

Символы

Для хранения отдельных текстовых символов используется тип char. Фактически это 4-байтное число, хранящее код символа в таблице Unicode.

Rust позволяет указать символ в исходном коде программы, как текстовый знак, взятый в одинарные кавычки.

#![allow(unused)]

fn main() {

let a = 'a';

let smile = '☺';

let book = '本';

}Unit

Тип Unit — аналог типа void в C, Java и других им подобных языках. Как правило, он используется для обозначения типа результата в функциях, которые не возвращают какое-либо значение.

Хоть тип и называется “Unit”, в коде он обозначается как () .

Принципиальное отличие типа Unit, являющегося множеством-синглтон, от типа void, который представляет пустое множество, заключается в том, что у типа Unit есть одно единственное значение —(). Мы можем даже создать переменную типа Unit и присвоить ей () .

#![allow(unused)]

fn main() {

let a: () = ();

}Tip

Чем не подходит void? Тип Unit появился в языках, которые испытали на себе влияние функционального программирования. Дело в том, что в функциональном программировании функция рассматривается, в первую очередь, как математическая функция, т.е. отображение значения из множества аргументов в значение из множества результатов. Здесь и появляется фундаментальная проблема типа

void: это пустое множество, в котором нет значений. Это сильно усложняет моделирование системы типов для таких важных в функциональном программировании операций, как композиция функций.В чисто функциональном языке Haskell даже имеется специальная функция

absurd, которая принимает аргумент типа Void и возвращает некое значение.absurd :: Void -> aКакое это значение и какого оно типа — не важно, так как эту функцию невозможно вызвать, ведь для её вызова необходим элемент из пустого множества Void, а такой не существует.

Never type

Еще один интересный тип, обусловленный особенностями системы типов данных в языках, испытавших воздействие функционального программирования, — never type.

В коде этот тип обозначается как !

Этот тип практически никогда не указывается явно и даже не наблюдается в коде. Более того, если не знать о его наличии, то можно годами писать на Rust и даже не подозревать о его существовании.

На данном этапе мы пока что не сможем разобраться с этим типом. Скажем только, что компилятор использует этот тип для выражений, которые никогда не возвращают значение в вызывающий код. Например, для функции выхода из программы.

Мы подробнее рассмотрим never type в главе Функции.

Приведение типов

Для того чтобы преобразовать один тип данных в другой, используется оператор as.

Синтаксис:

значение as Тип

Пример:

fn main() {

let a: i32 = 5;

let b: i64 = a as i64;

let c: i32 = b as i32;

let d: f32 = 7.0;

let e: i32 = d as i32;

let f: bool = true;

let g: i32 = f as i32; // 1

let h = false as i32; // 0

let i = 'A' as i32; // 65

let j = 66 as char; // B

}Rust является языком со строгой типизацией, поэтому в нём отсутствуют неявные преобразования типов, как в C. Любое преобразование типов нужно указывать явно при помощи оператора as.

Печать на консоль

Как мы уже видели в примере “Hello World” из главы Первый взгляд, для печати на консоль используется вызов println!.

Функция println! не так проста, как кажется. Да и не функция это никакая, а макрос. Причём если вы знакомы с макросами в C, то позвольте вас сразу успокоить: в Rust макросы куда безопаснее и удобнее.

Разбираться с тем, как устроены макросы в Rust и как именно работает макрос println!, мы будем потом в главе Декларативные макросы. А пока что давайте просто посмотрим на примеры использования println!, которые нам понадобятся для изучения последующего материала.

Чтобы напечатать строку на консоль, нужно просто передать её в вызов println! в качестве аргумента.

#![allow(unused)]

fn main() {

println!("Print just text");

}Если же нужно вывести на консоль значение переменной, то в вызов println! необходимо передать два аргумента:

- 1-й аргумент: строка с текстом для печати на консоль, которая в том месте, где мы хотим вывести значение переменной, содержит форматирующую комбинацию

{} - 2-й аргумент: переменная, значение которой встанет на место форматирующей комбинации

{}

Например:

fn main() {

let magic_number: i32 = 5;

println!("Number is {}", magic_number);

}Если скомпилировать и запустить эту программу, то мы увидим следующее:

$ rustc main.rs

$ ./main

Number is 5

Note

Это пример сборки и выполнения в Linux. В Windows сборка и запуск будут выглядеть как:

rustc main.rs main.exe Number is 5

Если мы хотим распечатать две переменные, то в форматирующей строке должны указать две {} комбинации и далее передать две переменные:

#![allow(unused)]

fn main() {

let number_1 = 5;

let number_2 = 6;

println!("Number 1 is {}, number 2 is {}", number_1, number_2);

}Альтернативно, переменную можно указывать не после форматирующей строки, а непосредственно в ней — внутри фигурных скобок:

#![allow(unused)]

fn main() {

let magic_number: i32 = 5;

println!("Number is {magic_number}");

}Также имеется комбинированный вариант: когда внутри {} мы задаём псевдоним, а после привязываем к этому псевдониму значение.

#![allow(unused)]

fn main() {

let magic_number: i32 = 5;

println!(

"Number is {num}, num in the power of two is {square}",

num = magic_number,

square = magic_number * magic_number

);

}Вышеуказанным образом выводить на консоль можно только значения типов, для которых определён трэйт std::fmt::Display. Про трэйты мы поговорим позже, а пока что нам нужно знать то, что через {} можно передавать только значения типов, для которых явно прописано, как значения этих типов преобразуются в строки.

Для всех примитивных типов в стандартной библиотеке Rust уже имеется реализация std::fmt::Display, что позволяет непосредственно выводить их через println!. Но для большей части типов (например, для массивов) это не так.

Однако если в вызове println! в форматирующей строке заменить {} на {:?}, то мы сможем выводить значения типов, для которых определён трэйт std::fmt::Debug, а таких типов подавляющее большинство.

Пока что не заостряйте внимание на этом моменте, так как мы его коснёмся еще не раз.

Скоупы

В Rust время жизни переменной ограничено скоупом — блоком из фигурных скобок, в котором она объявлена. По завершению скоупа все переменные, объявленные в нём, автоматически удаляются.

fn main() {

let a = 1;

{

let b = 2;

// В этом месте существуют и a, и b

} // Выход из скоупа: b удаляется

// В этом месте существует только a

let c = 3;

} // Выход из скоупа: a и c удаляютсяЗначение скоупа

В Rust каждый скоуп возвращает значение. Это значит, что результат скоупа можно присвоить переменной. Само же значение, возвращаемое скоупом — это последнее значение, вычисленное в скоупе.

#![allow(unused)]

fn main() {

let a: i32 = {

let x = 1;

let y = 2;

x + y // последнее вычисленное выражение

};

println!("{a}"); // 3

}Будьте внимательны: чтобы результат последнего выражения стал результатом скоупа, после него не должно быть точки с запятой.

Дело в том, что в отличие от C, где ; означает конец текущего выражения, в Rust ; служит разделителем между выражениями. То есть, например, выражение

{ a; }

трактуется как

{ a; () }

и, следовательно, результат всего скоупа будет — Unit, а не a.

Вот так будет выглядеть пример выше, если по ошибке поставить ; в конце скоупа.

#![allow(unused)]

fn main() {

let a: () = {

let x = 1;

let y = 2;

x + y;

};

}Тот факт, что скоуп возвращает значение, используется в ряде других конструкций, о которых мы поговорим далее.

Ссылки

Ссылка — это переменная, которая “ссылается” на данные, хранимые в другой переменной.

Для создания ссылки на значение, хранимое в переменной, используется оператор &.

let переменная: Тип = значение;

let ссылка: &Тип = &переменная;При этом тип ссылки будет &тип_изначальной_переменной.

Например:

fn main() {

let a: i32 = 5;

let ref_a: &i32 = &a;

println!("Value in a is {}", *ref_a); // Value in a is 5

}Оператор * в выражении *ref_a используется для получения значения, на которое ссылается ссылка.

Ссылки, как и переменные, по умолчанию являются немутабельными, т.е. с их помощью можно читать значение оригинальной переменной, но не изменять его. Чтобы создать мутабельную ссылку, нужно вместо & использовать &mut. Разумеется, мутабельную ссылку можно получить только для мутабельной переменной:

fn main() {

let mut a: i32 = 5;

let ref_a: &mut i32 = &mut a;

*ref_a = 99;

println!("Value in a is {}", *ref_a); // Value in a is 99

}Note

В отличие от указателей в C, которые являются физическим типом данных, т.е. ячейкой в памяти, в которой хранится адрес, ссылка в Rust является скорее семантической сущностью. То есть в большинстве случаев создание ссылки в коде не приводит к созданию дополнительных сущностей в памяти программы: компилятор просто подменяет взаимодействие с ссылкой на взаимодействие со значением непосредственно. При этом на уровне кода программы ссылка ведёт себя так, словно это физический “указатель” на данные, хранимые в другой переменной.

В Rust ссылки являются безопасными: компилятор отслеживает время жизни ссылок относительно времени жизни переменных, на чьи данные они указывают. При попытке сослаться на данные, принадлежащие уже уничтоженной переменной, компилятор выдаст ошибку.

Мы поговорим подробнее о ссылках в главе Владение, а также в главе Лайфтаймы.

Массивы

Массивы в Rust представляют из себя непрерывную последовательность значений, размер которой известен на момент компиляции.

Тип массива состоит из двух частей: тип элементов массива и количество элементов.

[тип_элементов; количество_элементов]

Например, массив из трёх элементов типа i32:

#![allow(unused)]

fn main() {

let arr: [i32; 3] = [1, 2, 3];

}Размер массива нельзя задать во время выполнения программы (например, считать с консоли желаемый размер и сконструировать его). Он обязательно должен быть известен во время компиляции, что делает массив полезным в редких случаях.

Например, массив из четырёх байт хорошо подходит для хранения IPv4 адреса.

fn main() {

let mut arr: [u8; 4] = [192, 168, 0, 1];

println!("Array is {arr:?}");

// Напечатает: Array is [192, 168, 0, 1]

}Note

Как мы видим, здесь для вывода на консоль мы используем форматирующую последовательность

{:?}вместо{}. Как мы говорили в разделе Вывод на консоль, это необходимо, так как массив не реализует трэйтstd::fmt::Display, но, как и почти все стандартные типы, реализуетstd::fmt::Debug.

Индексация элементов массива начинается с нуля.

fn main() {

let arr: [u8; 4] = [192, 168, 0, 1];

println!("{}", arr[0]); // 192

}Как и любые другие переменные, переменная-массив по умолчанию немутабельна. Чтобы массив можно было изменять, он должен быть объявлен с ключевым словом mut.

fn main() {

let mut arr = [1,2,3];

arr[1] = 55;

println!("Array is {arr:?}");

// Напечатает: Array is [1, 55, 3]

}Массивы, объявленные внутри функций, всегда располагаются на стеке.

Существует механизм, позволяющий перенести массив в кучу, однако придумать практическое применение для такой операции весьма непросто.

Вектор

Как мы уже знаем, размер массива должен быть известен во время компиляции, что делает его бесполезным для сценариев, при которых размер вычисляется в процессе работы программы.

Тип Vec (вектор) представляет из себя непрерывную последовательность элементов, размер которой может определяться и изменяться во время выполнения программы.

Note

Vec<T>является обобщённой (generic) структурой. И генерики, и структуры мы изучим только несколько глав спустя, однако вектор является настолько вездесущей структурой данных, что изучать даже базовые конструкции Rust без него будет очень сложно. Поэтому, на данном этапе мы только разберёмся, как с ним работать и как он располагается в памяти.

Если же вы знакомы с C++, то вы уже, скорее всего, провели аналогию с шаблонным классомstd::vector, и оказались полностью правы.

Если вы знакомы с Java, то считайте вектор близким родственником классаArrayList<T>.

Для начала рассмотрим пример использования вектора:

fn main() {

// Создаём пустой вектор

let mut my_vec: Vec<i32> = Vec::new();

my_vec.push(1); // Добавляем 1 в конец вектора

my_vec.push(2); // Добавляем 2 в конец вектора

my_vec.push(3); // Добавляем 3 в конец вектора

// Копируем в переменную third значение элемента с индексом 2 (индексация с нуля)

let third: i32 = my_vec[2];

println!("3-rd element: {}", third);

}Как видно, с точки зрения использования, вектор можно рассматривать просто как динамически расширяемый массив.

Лэйаут (расположение) в памяти

Теперь поговорим о том, как вектор хранится в памяти. Когда мы создаём переменную вектора, то на стеке располагается только его “служебная информация”, а сами данные хранятся в куче.

На стеке хранятся такие 3 поля:

- указатель на начало буфера в куче — в этом буфере хранятся сами элементы вектора

- счётчик количества элементов, записанных в буфере в куче

- размер буфера в куче

Лэйаут (layout) вектора из примера выше в оперативной памяти выглядит так:

Размер буфера в куче, который вектор изначально создаёт для хранения элементов, не стандартизирован, но на данной диаграмме мы предположили, что он равен 5.

Если желаемый размер буфера в куче известен заранее, то его можно задать явно, заменив Vec::new() на Vec::with_capacity(размер). Это приведёт к тому, что вектор аллоцирует первичный буфер в куче ровно такого размера, чтобы иметь возможность вместить ровно заданное количество элементов.

При добавлении элементов в вектор, счётчик элементов в буфере (len) увеличивается. Когда len становится равным capacity — то есть буфер в куче будет полностью заполнен, тогда вектор аллоцирует новый буфер большего размера, копирует в него все элементы из старого буфера и затем удаляет старый буфер. Последующее добавление элементов продолжится уже в новый буфер.

#![allow(unused)]

fn main() {

let mut my_vec: Vec<i32> = Vec::with_capacity(3);

my_vec.push(1);

my_vec.push(2);

my_vec.push(3);

// <- на этом месте буфер, чья вместимость - 3 элемента, уже заполнен

// Добавление 4-го элемента приведёт к выделению нового буфера

// и копированию в него 1,2,3.

// После этого 4 будет добавлено уже в новый буфер.

my_vec.push(4);

}Макрос vec!

В предыдущем примере для создания вектора с элементами мы сначала создали пустой вектор, а затем один за другим добавили в него все необходимые элементы. Согласитесь, что добавлять элементы по одному — весьма неудобно.

Поэтому, учитывая, что вектор является наиболее часто используемой структурой данных, в стандартную библиотеку Rust включили специальный макрос vec![], который берёт на себя бремя поэлементного добавления элементов в вектор.

При помощи этого макроса, мы можем переписать пример выше таким образом:

fn main() {

let mut my_vec = vec![1,2,3];

let third: i32 = my_vec[2];

println!("3-rd element: {}", third);

}Как работает этот макрос станет понятно только после прочтения главы Декларативные макросы.

Слайсы

Подобно тому, как ссылка указывает на данные, принадлежащие некой переменной, слайс — это специальная ссылка, которая указывает на последовательность элементов, как правило, принадлежащих другой переменной (вектору, массиву, и т.д.).

Аналогично тому, как ссылка создаётся оператором &, слайс создаётся оператором &[].

#![allow(unused)]

fn main() {

let arr: [i32; 5] = [0, 1, 2, 3, 4]; // массив

let slice1: &[i32] = &arr[..]; // слайс на все элементы массива

let slice2: &[i32] = &arr[2..=4]; // слайс на элементы со 2го по 4-й включительно

// альтернативно можно было бы написать

// let slice2: &[i32] = &arr[2..5]; // то есть со 2-го до 5-го не включительно

}Слайс позволяет обращаться к элементам по их индексу (относительно начала слайса, а не относительно начала оригинальной последовательности).

fn main() {

let arr = [0, 1, 2, 3, 4];

let slice: &[i32] = &arr[2..=4]; // слайс на элементы со 2го по 4-й

println!("{}", slice.len()); // 3 (размер слайса)

println!("{}", slice[2]); // 4 (2-й по индексу элемент слайса)

}В отличие от обычных ссылок, которые, как правило, эфемерны (не представлены отдельными ячейками в памяти), слайсы хранятся в памяти в виде пары полей:

- адрес первого элемента последовательности

- количество элементов

По умолчанию слайсы, как и ссылки, — немутабельны. Для того, чтобы сделать мутабельный слайс, нужно использовать ключевое слово mut.

Рассмотрим пример изменения элементов вектора посредством мутабельного слайса:

fn main() {

let mut v: Vec<i32> = Vec::with_capacity(5);

v.push(0);

v.push(1);

v.push(2);

v.push(3);

let slice: &mut [i32] = &mut v[1..3]; // слайс на элементы со 1го до 3го

slice[0] = 9;

println!("v[1]: {}", v[1]); // 9

}В памяти это соотношение вектора и слайса выглядит так:

Строки

Note

Если эта глава кажется вам трудной при первом прочтении, не пытайтесь понять её полностью. Вернитесь к ней после прочтения глав про Владение и Структуры.

Строки в Rust хранятся в виде буферов с символами в UTF-8 кодировке. При этом в Rust есть два основных типа для строк, которые отличаются тем, как они взаимодействуют с этим буфером: &str и String.

&str (строковый слайс)

Если мы напишем в коде программы строковый литерал (строку в двойных кавычках), то эта строка будет иметь тип &str.

#![allow(unused)]

fn main() {

let s: &str = "some text";

}По сути &str — это слайс, ссылающийся на буфер с последовательностью символов в кодировке UTF-8.

В каком-то смысле такие строки похожи на const char* строки в языке C, с той разницей, что в отличие от C, &str, будучи слайсом, хранит не только начальный адрес буфера в памяти, но и его длину.

Когда компилятор находит в коде строковый литерал, он, как правило, помещает эту строку в сегмент данных (или в сегмент кода, в зависимости от целевой платформы), и там эта строка “живёт” от самого начала программы и до её конца.

Тип &str не занимается управлением памяти, в которой находится строка, он просто ссылается на данные в памяти. При этом эта память может принадлежать как сегменту данных, так и куче (и являться собственностью объекта String) или даже располагаться на стеке.

String

Если &str — это слайс, который ссылается на буфер со строкой, но никак не управляет этим буфером, то String, наоборот, является собственником буфера, в котором содержится строка.

Технически String является обёрткой над вектором Vec<u8>, который хранит последовательность символов в кодировке UTF-8. Поэтому String всегда единолично владеет буфером со своей строкой, и этот буфер всегда располагается в куче.

При этом для любого String всегда можно создать слайс &str, который будет ссылаться на строковый буфер, находящийся во владении String.

Есть 3 способа создать переменную типа String:

- При помощи конструктора

String::from - При помощи

String::newсоздать пустую строку и далее наполнить её отдельно - Из

&strпри помощи методаto_string()

Конструктор String::from

Наиболее понятный способ создания объекта String — функция-конструктор (о них мы поговорим в главе Структуры) String::from(&str), которая в качестве аргумента принимает слайс &str. Эта функция:

- создаёт объект

String, который как мы уже сказали, — просто обёртка надVec<u8>(вектором хранящим буфер с элементами типаu8) - далее из аргумента

&strкопирует строку в свежесозданный вектор - и после возвращает готовый, инициализированный объект

String

fn main() {

// слайс на статическую строку, находящуюся в сегменте даных

let slice: &str = "text";

// Создаст в куче буфер и скопирует в него "text".

// На стеке будет тройка значений, как у Vec:

// адрес буфера, общий размер буфера и количество заполненных строкой байт

let s = String::from(slice);

}Note

Разумеется, гораздо короче и проще написать просто

String::from("text"), что в большинстве случаев и делают. В примере выше мы создали отдельную переменнуюsliceисключительно для наглядности.

Конструктор String::new

Функция-конструктор String::new просто создаёт новый объект String с пустым строковым буфером. Это может быть нужно, например, для того, чтобы передать объект String в функцию, которая заполнит его текстом.

Например, функция, которая читает строку с консоли, в качестве параметра принимает мутабельную ссылку на объект String, в который будет записан текст, считанный с консоли.

fn main() {

println!("Please enter some text and hit Enter button");

let mut buf = String::new(); // создаём пустую строку

std::io::stdin().read_line(&mut buf); // считываем текст с консоли в buf

println!("You have entered: {buf}");

}Также в пустую строку (да и не только в пустую) можно добавлять символы при помощи метода push(char) или сразу строковые слайсы при помощи метода push_str(&str).

fn main() {

let mut s = String::new();

s.push('H');

s.push('e');

s.push('l');

s.push('l');

s.push('o');

s.push_str(" world!");

println!("{s}"); // Hello world!

}Метод to_string()

Последний способ создания объекта String — вызов метода to_string() на объекте слайса &str. По сути, этот метод делает абсолютно то же самое, что и String::from(&str), только с другим синтаксисом.

fn main() {

let s: String = "text".to_string();

}&str и String в памяти

Чтобы подытожить, как &str и String располагаются в памяти, давайте рассмотрим следующий пример, в котором мы:

- Создаём слайс

&strиз строкового литерала - Далее создаём

Stringиз этого слайса - Создаём слайс, ссылающийся на строковый буфер объекта

String

fn main() {

// Компилятор увидит константный строковый литерал и поместит

// такую строку в сегмент статических данных.

let a_slice_1: &str = "text";

// Создаём String из символов, на которые указывает слайс.

// Это приведёт к созданию копии символов строки в куче.

let a_string: String = String::from(a_slice_1);

// Создаём второй слайс, который указывает на буфер символов в хипе,

// принадлежащей String-строке.

let a_slice_2: &str = a_string.as_str();

}Примерно так эти строки будут располагаться в памяти:

Макрос format!

Мы уже знакомы с макросом println!, который используется для вывода на консоль. Этот макрос в качестве аргумента принимает форматирующую строку, в которую при помощи {} можно “встраивать” значения.

Стандартная библиотека предлагает еще один макрос — format!. Он принимает на вход такую же форматирующую строку, как и println!, только, в отличие от последнего, он не печатает текст на консоль, а возвращает его в виде объекта String.

fn main() {

let s: String = format!("{} in the power of the 2 is {}", 3, 9);

println!("{s}"); // 3 in the power of the 2 is 9

}Условный оператор if

Как и в большинстве языков программирования, в Rust условный оператор if тоже есть.

Его синтаксис имеет вид:

if условие_1 {

выражение_1

} else if условие_2 {

выражение_2

} else {

выражение_3

}Например:

fn main() {

let a = 10;

if a % 2 == 0 {

println!("a is even");

} else {

println!("a is odd");

}

}В Rust, в отличие от C и Java, тело условной ветки обязательно должно быть обрамлено в фигурные скобки, даже если ветка содержит только одно выражение.

Результат оператора if

Оператор if является выражением, т.е. возвращает значение, которое можно присвоить переменной. Результатом всего if выражения является результат последнего выражения в отработавшей ветке.

#![allow(unused)]

fn main() {

let a = -5;

let mod_a: i32 =

if a < 0 {

-a

} else {

a

};

println!("{mod_a}"); // 5

}Здесь важно заметить, что для того, чтобы оператор if возвращал значение, последнее выражение в условной ветке НЕ должно заканчиваться знаком ;. Дело в том, что, как мы уже сказали, тело условной ветки всегда должно быть обрамлено в фигурные скобки, а это значит, что она является скоупом. Как мы уже знаем из главы Скоупы, если в конце последнего выражения скоупа стоит ;, то скоуп возвращает ().

#![allow(unused)]

fn main() {

let a = -5;

let mod_a: () =

if a < 0 {

-a; // то же самое, что и { -a; () }

} else {

a; // то же самое, что и { a; () }

};

println!("{mod_a:?}"); // Напечатает ()

}Tip

В английском языке есть принципиальная разница между понятиями statement (утверждение) и expression (выражение).

Словом statement называют код, который выполняется и ничего не возвращает. Например, в C/Java конструкция, заканчивающаяся знаком

;является statement.Expression — это выражение, которое вычисляет и возвращает значение. Примером expression в C/Java является

1 + 1, так как оно возвращает2.В русском языке, как правило, и statement и expression переводят как “выражение”, что создаёт путаницу.

Циклы

while

Цикл while в Rust работает и выглядит так же, как и в других императивных языках:

while условие {

тело цикла

}Например, вывод на консоль чисел от 5 до 0 (не включительно).

fn main() {

let mut n = 5;

while n > 0 {

println!("{n}");

n -= 1;

}

}do-while

В Rust нет цикла do-while, но при большой необходимости его можно имитировать через while:

Такой код

|

работает словно

|

loop

В Rust есть специальный “бесконечный” цикл — loop. По сути, это просто аналог while true.

loop {

тело цикла

}Как и из while true цикла, из loop можно выйти при помощи оператора break.

Например: программа, которая выводит те элементы последовательности Фибоначчи, которые меньше указанного числа (мы подразумеваем, что указанное число всегда больше 1).

fn main() {

let maximum = 30;

let mut a = 0;

let mut b = 1;

print!("{a} {b}");

loop {

let next = a + b;

if next > maximum {

break;

}

print!(" {next}");

a = b;

b = next;

}

}Оператор break для цикла loop имеет еще одну функциональность: он возвращает значение.

#![allow(unused)]

fn main() {

let mut counter = 0;

let result = loop {

counter += 1;

if counter == 10 {

break counter * 2; // возвращаем из цикла

}

};

println!("The result is {}", result); // 20

}Тип оператора break — never type.

for

В Rust отсутствует “классический” цикл for (как в C) — только for-each, который предназначен для перебора элементов последовательностей.

Синтаксис:

for переменная in последовательность {

тело цикла

}Пример: перебор элементов массива.

fn main() {

let arr = [10, 20, 30, 40, 50];

for element in arr {

println!("the value is: {}", element);

}

}При помощи for можно перебирать элементы массивов, слайсов, векторов и еще целого ряда коллекций.

Перебор диапазона

В Rust нет “классического” цикла for вида for (int i=0; i<N; i++). Однако такой перебор числового диапазона требуется довольно часто.

К счастью, в Rust есть диапазоны (Range), которые задаются как начало .. конец, и могут использоваться для перебора элементов в цикле for.

#![allow(unused)]

fn main() {

for i in 0 .. 10 {

print!("{}, ", i);

}

// Напечатает: 0, 1, 2, 3, 4, 5, 6, 7, 8, 9,

}Этот цикл перебирает числа от 0 до 10 (не включительно).

Чтобы перебрать числа от 0 до 10 (включительно), надо вместо 0 .. 10 указать 0 ..= 10.

Note

Детальнее о цикле for мы поговорим в главах Владение и Итераторы. Также в главе про Итераторы мы подробнее разберём диапазоны.

Функции

Как и в других языках программирования, в Rust функции — это механизм, позволяющий разбить программу на отдельные гранулированные подпрограммы.

Синтаксис объявления функции:

fn func_name(arg1: Тип1, arg2: Тип2) -> ТипВозвращаемогоЗначения {

тело функции

}Пример:

fn sum(a: i32, b: i32) -> i32 {

a + b

}

fn safe_divide(a: f32, b: f32) -> f32 {

if b != 0.0 {

a / b

} else {

0.0

}

}

fn main() {

let a = sum(1, 2);

println!("{a}");

let b = safe_divide(12.0, 4.0);

println!("{b}");

}При объявлении аргументов функции можно вставлять запятую после последнего аргумента, и поведение будет таким же, как и без неё.

fn sum(a: i32, b: i32,) -> i32 { .. }return

Как мы видим, последнее вычисленное значение автоматически является результатом функции.

При необходимости “досрочно” выйти из функции, следует явно использовать оператор return:

fn safe_divide(a: f32, b: f32) -> f32 {

if b == 0.0 {

return 0.0;

}

a / b

}

fn main() {

println!("12 / 3 = {}", safe_divide(12.0, 3.0));

println!("12 / 0 = {}", safe_divide(12.0, 0.0));

}Функции внутри функций

Rust позволяет объявлять функцию внутри другой функции.

Если часть функциональности функции хорошо гранулирована и используется несколько раз и при этом не нужна больше нигде в программе, то её можно вынести в отдельную внутреннюю функцию.

// Возвращает i-й элемент последовательности Фибоначчи.

// Индексация элементов последовательности - с нуля.

fn fibonacci_nth_element(index: usize) -> u32 {

if index == 0 {

return 0;

}

if index == 1 {

return 1;

}

// Высчитывет i-й элемент последовательности Фибоначчи

// * x0 - i-й элемент последовательности

// * x1 - (i+1)-й элемент последовательности

// * next_index - индекс следующего (i+2) элемента

// * desired_index - индекс искомого элемента

fn next_fibonacci(x0: u32, x1: u32, next_index: usize, desired_index: usize) -> u32 {

let x2 = x0 + x1;

if next_index == desired_index {

x2

} else {

next_fibonacci(x1, x2, next_index + 1, desired_index)

}

}

next_fibonacci(0, 1, 2, index)

}

fn main() {

println!("{}", fibonacci_nth_element(0)); // 0

println!("{}", fibonacci_nth_element(1)); // 1

println!("{}", fibonacci_nth_element(2)); // 1

println!("{}", fibonacci_nth_element(3)); // 2

println!("{}", fibonacci_nth_element(4)); // 3

}return и never type

Tip

Приведённая ниже информация не является необходимой для программирования на Rust, а скорее просто даёт лучшее понимание системы типов.

В главе Примитивные типы данных мы уже упоминали never type !, который используется для тех выражений, которые не возвращают управление в вызывающий код.

Оператор return возвращает значение типа !, так как он завершает исполнение функции и, следовательно, ничего в неё не возвращает.

fn gen_num() -> i32 {

// Переменная v имеет тип !

let v = return 5;

}

fn main() {

let a = gen_num();

}Never type не представляет каких-то реальных данных, а просто играет роль заглушки, чтобы “склеить” воедино систему типов Rust. Давайте рассмотрим примере:

fn safe_divide(a: f32, b: f32) -> f32 {

let non_zero_divider: f32 =

if b != 0.0 {

b

} else {

return 0.0

};

a / non_zero_divider

}

fn main() {

println!("12 / 0 = {}", safe_divide(12.0, 0.0));

}Обратите внимание, что тип переменной non_zero_divider — f32. Но как так получается? Ведь тип результата в первой ветке выражения if — f32, а тип результата во второй ветке — ! (never type).

Дело в том, что тип never type автоматически приводится к любому другому типу. Это абсолютно безопасно, так как в реальности это преобразование значения типа ! в значение другого типа всё равно никогда не происходит. Но именно это свойство never type является тем самым “клеем”, который согласовывает типы в подобных выражениях.

Tip

Программисты знакомые с языком Scala, могут провести аналогию с типом

Nothing.

const функции

В Rust можно задать функцию, которая может быть выполнена на этапе компиляции. Такая функция отмечается ключевым словом const.

#![allow(unused)]

fn main() {

const fn func_name(arg1: Тип1, arg2: Тип2) -> ТипВозвращаемогоЗначения {

тело функции

}

}Например:

const PI: f32 = 3.14;

const TAU: f32 = double(PI);

const fn double(num: f32) -> f32 {

num * 2.0

}

fn main() {

println!("Tau = {TAU}");

}static переменные

Функция может содержать статические переменные, значения которых сохраняются между вызовами функций.

Это проще показать на примере.

fn sum_with_previous(x: i32) -> i32 {

static mut PREV: i32 = 0; // статическая переменная

unsafe {

let result = PREV + x;

PREV = x;

result

}

}

fn main() {

println!("{}", sum_with_previous(1)); // 1

println!("{}", sum_with_previous(2)); // 3

println!("{}", sum_with_previous(7)); // 9

println!("{}", sum_with_previous(-6)); // 1

}Функция sum_with_previous складывает значение аргумента со значением аргумента из своего предыдущего вызова. Для этого она использует статическую переменную PREV, которая живёт вне контекста вызова функции.

Как видно, PREV инициализируется нулём. Эта инициализация выполняется только для первого вызова функции.

Также хочется отметить, что всё взаимодействие с мутабельной статической переменной может выполняться только внутри блока unsafe. Дело в том, что потенциально эта функция может быть одновременно вызвана из нескольких параллельных потоков, что может привести к сохранению или чтению некорректного значения PREV одним из потоков. Это классический пример гонок за данные (data race), что в безопасном Rust недопустимо. Именно поэтому необходим unsafe блок.

Это первый раз, когда мы сталкиваемся с блоком unsafe. Мы еще познакомимся с ним подробнее, а пока что скажем, что вся ответственность за безопасность кода внутри блока unsafe ложится на плечи его автора. Поэтому стоит избегать использования небезопасного Rust, если в этом нет необходимости.

Как вы могли понять, мутабельные статические переменные не особо безопасны по своей природе и могут быть использованы без дополнительных механизмов синхронизации только в однопоточной среде. К счастью, в back-end приложениях вы скорее всего никогда не будете их использовать — мы рассмотрели их только для того, чтобы больше раскрыть тему функций.

Кортежи

Как мы знаем, массив в Rust — это последовательность заранее известного размера, содержащая элементы одинакового типа. Массивы хорошо подходят для хранения таких сущностей, как, например, координаты в пространстве: [x, y, z] — все три составляющие координаты имеют одинаковый тип. Но что делать, если для хранения какой-то сущности требуется последовательность элементов разного типа?

Например, мы разрабатываем картотеку для отдела кадров, и по каждому сотруднику нам необходимо хранить его полное имя, дату рождения и пометку, является ли сотрудник действующим, — всё это данные разных типов: String, u32 и bool. Решить нашу задачу могут помочь кортежи.

Кортеж — это последовательность заранее известного размера, которая может содержать элементы разных типов.

Tip

Программисты на Java могут провести аналогию с классами

Pair<T1,T2>иTriplet<T1,T2,T3>из библиотеки Apache Commons.

Синтаксис объявления кортежа выглядит так:

(значение_1, значение_2, …, значение_N)

Пример: кортеж для хранения имени сотрудника, даты его рождения и пометки, является ли он действующим сотрудником.

#![allow(unused)]

fn main() {

let employee: (&str, i32, bool) = ("John Doe", 1980, true);

}Доступ к элементам кортежа осуществляется при помощи . после которой следует индекс элемента (индексация с нуля).

#![allow(unused)]

fn main() {

println!(

"Name: {}, birth year: {}, active: {}",

employee.0, employee.1, employee.2

);

}Также для кортежей есть удобный синтаксис, который позволяет за раз “разложить” весь кортеж на элементы и присвоить эти элементы переменным.

#![allow(unused)]

fn main() {

let (name, birth_year, is_active) = employee;

}Note

Такая операция “разложения” на составляющие называется деструктурирующим присваиванием. О ней мы отдельно поговорим в главе Деструктурирование

Возврат кортежа из функции

Одно из удобных применений кортежа — возврат нескольких значений из функции.

Например, нам нужна функция, которая принимает в качестве аргумента последовательность чисел и разделяет её на две части: первая содержит все нечётные числа, вторая — все чётные.

fn split_to_odd_and_even(numbers: &[i32]) -> (Vec<i32>, Vec<i32>) {

let mut odds = Vec::new(); // для нечётных

let mut evens = Vec::new(); // для чётных

for n in numbers {

if n % 2 != 0 {

odds.push(*n);

} else {

evens.push(*n);

}

}

(odds, evens)

}

fn main() {

let numbers = vec![1,2,3,4,5,6,7,8,9];

let (odds, evens) = split_to_odd_and_even(&numbers); // получаем слайс на вектор

println!("Odd numbers: {odds:?}");

println!("Even numbers: {evens:?}");

}Как мы видим, здесь в теле функции split_to_odd_and_even мы создали два вектора и оба вернули из функции путём “заворачивания” в кортеж.

Также заметим, что функция split_to_odd_and_even в качестве аргумента ожидает слайс, поэтому при помощи оператора & мы создаём слайс, указывающий на элементы вектора. Такая передача последовательности в функцию посредством слайса — одна из распространённых практик в Rust. Это позволяет вызывать функцию как для вектора, так и для массива.

Например, так бы выглядел вариант с массивом:

fn main() {

let numbers = [1,2,3,4,5,6,7,8,9];

let (odds, evens) = split_to_odd_and_even(&numbers); // получаем слайс на массив

println!("Odd numbers: {odds:?}");

println!("Even numbers: {evens:?}");

}Владение

(ownership)

Главная отличительная особенность Rust от других языков заключается в том, что он, не имея сборщика мусора, предлагает производительность уровня языков с ручным управлением памятью. При этом Rust не требует ручного управления памятью и гарантирует отсутствие утечек памяти. Такой результат достигается за счёт концепции владения данными.

Дело в том, что в Rust любой объект непримитивного типа должен иметь только одного владельца. Владелец — это переменная, которой присвоен объект. Поэтому когда значение одной переменной присваивается другой переменной, владение объектом переходит от первой переменной ко второй. При этом первая переменная становится недействительной.

Рассмотрим пример:

fn main() {

let s1 = String::from("some string");

let s2 = s1; // владение строкой переходит от s1 к s2

// В этом месте переменная s1 уже недействильна.

println!("{}", s2); // Теперь можно работать только с s2, но не s1

}Попытка обратиться к недействильной переменной приведёт к ошибке компиляции:

fn main() {

let s1 = String::from("some string");

let s2 = s1;

println!("{}", s1);

// 2 | let s1 = String::from("some string");

// | -- move occurs because `s1` has type `String`, which does not implement the `Copy` trait

// 3 | let s2 = s1;

// | -- value moved here

// 4 |

// 5 | println!("{}", s1);

// | ^^ value borrowed here after move

}Тот факт, что у любого объекта есть только один владелец, позволяет компилятору однозначно понять в каком месте память, занимаемая объектом, должна быть очищена. И это место — там, где владелец объекта прекращает своё существование.

Таким образом, в тех местах где переменные прекращают своё существование, компилятор вставляет код вызова деструктора для данных, которыми переменные владели.

Такой подход позволяет управлять памятью без сборщика мусора, при этом гарантировать отсутствие утечек.

Механизм компилятора Rust, который отслеживает время жизни объектов и гарантирует, что память будет очищена, когда нужно, и что в коде не будет обращений к уже очищенной памяти, называется борроу-чекером (borrow-checker).

Владение и скоупы

Как мы знаем, время жизни переменной привязано к скоупу, в котором эта переменная объявлена: когда скоуп завершается, все входящие в него переменные пропадают, а принадлежавшая им память очищается.

Однако переменная, объявленная внутри скоупа, может “отдать” свои данные другой переменной, которая объявлена за пределами этого скоупа.

fn main() {

let s1;

{

let s2 = String::from("some string");

s1 = s2; // значение отдаётся переменной из внешнего скоупа

}

println!("{s1}"); // OK

}Этот пример тривиален, однако по нему хорошо видно, как работает передача владения при переходе между скоупами. Эти знания нам понадобятся в дальнейшем, когда мы будем разбирать Лайфтаймы

Передача владения

Мы уже знаем, что передача владения объектом происходит при присваивании, но есть и другие сценарии.

Вот полный список операций, при которых происходит передача владения объектом:

- присваивание

- передача объекта в функцию в качестве аргумента

- возврат значения из функции

- захват объекта замыканием (этот сценарий мы рассмотрим позже)

Давайте рассмотрим сценарий передачи владения при вызове функции:

fn main() {

let name = String::from("Stas");

// Строка из переменной name уходит в функцию, делая name недействительной

let greeting = greet(name);

// <- Здесь переменная name уже не может быть использована

println!("{}", greeting); // Hello Stas!!!

}

fn greet(name: String) -> String {

// объект строки, возвращаемый вызовом format, перемещается в вызывающий код

format!("Hello {}!!!", name)

}Теперь, когда мы разобрались с тем, что передача переменной в качестве аргумента уничтожает эту самую переменную, давайте посмотрим на пример, который выглядит вполне обычно с точки зрения большинства языков программирования, но станет сюрпризом для изучающих Rust.

Допустим, мы хотим написать программу, которая выводит на консоль строку (неважно откуда мы её берём), а также информацию о длине этой строки. Для того, чтобы подсчитать длину строки, мы сделаем отдельную функцию, которая будет просто вызывать len() на переданной строке.

fn len_of_string(s: String) -> usize {

s.len()

}

fn main() {

let s = String::from("aaa");

let len = len_of_string(s);

println!("{}", s); // <- переменная s уже недействильна здесь

}И вот здесь нас сразу ожидает проблема: мы пытаемся распечатать переменную s, которая уже не действительна, так как она отдала владение своими данными в вызов функции на предыдущей строке.

Как мы можем решить эту проблему? Исключительно абсурдности ради давайте вспомним, что при помощи кортежей мы можем возвращать из функции несколько значений, а значит, мы можем вернуть обратно объект, переданный как аргумент.

fn len_of_string(s: String) -> (String, usize) {

let length = s.len();

(s, length)

}

fn main() {

let s = String::from("aaa");

let (s, len) = len_of_string(s);

println!("Len of {s} is {len}"); // "Len of aaa is 3"

}Выглядит странно, но хорошо демонстрирует, как работает перемещение владения объектом при вызове функций.

К счастью, Rust предоставляет куда более удобный механизм для решения этой проблемы — одалживание.

Note

В стандартной библиотеке Rust есть функция drop, которая уничтожает переданный ей объект.

#![allow(unused)] fn main() { let s = String::from("aaa"); drop(s); }Если посмотреть реализацию функции

drop(мы пока не знакомы с генериками, поэтому не можем полностью понять её сигнатуру), то мы увидим, что она не делает ничего.#![allow(unused)] fn main() { pub fn drop<T>(_x: T) {} }Уничтожение объекта происходит просто за счёт того, что функция

drop, забирает себе владение над объектом и не передаёт его никому дальше.

Одалживание (borrowing)

Вместо того, чтобы передавать в качестве аргумента значение переменной, мы можем передавать ссылку на это значение. Таким образом, владение объектом остаётся за переменной, и мы лишь даём функции попользоваться объектом.

fn len_of_string(s: &String) -> usize {

s.len()

}

fn main() {

let s = String::from("aaa");

let len = len_of_string(&s);

println!("Len of {s} is {len}");

}Такая передача аргумента по ссылке в Rust называется “одалживаем” (borrowing). Это название обусловлено тем, что функция словно берёт объект попользоваться, но возвращает его собственнику после завершения своей работы.

Tip

Если бы мы писали подобную функцию для реальной программы, мы бы разумеется сделали тип аргумента в

len_of_stringне ссылкой на строку&String, а слайсом&str, что позволило бы вызывать функцию как для строкString, так и для строковых литералов.

Мы написали эту функцию таким образом — исключительно для того чтобы было проще объяснить одалживание.

Безопасность ссылок (referential safety)

Из раздела выше мы уже знаем, что в Rust можно взять ссылку на объект и передать её в функцию.

Но давайте рассмотрим такой сценарий:

1) Мы создаём вектор с буфером на 3 элемента и заполняем его значениями.

let mut vector: Vec<i32> = Vec::with_capacity(3);

vector.push(1);

vector.push(2);

vector.push(3);2) Дальше мы берём немутабельную ссылку на второй элемент вектора. Эта ссылка “указывает” непосредственно на адрес в памяти, по которому хранится второй элемент.

let reference: &i32 = &vector[1];3) Ссылка на второй элемент еще “жива”, но теперь мы берём еще и мутабельную ссылку на весь вектор целиком. С её помощью мы добавляем в вектор еще один элемент. Буфер вектора был уже заполнен, поэтому в куче аллоцируется новый буфер большего размера, и в него копируются все элементы из старого буфера. После этого в новый буфер добавляется новый элемент, а старый буфер очищается из памяти.

let vec_ref = &mut vector;

vec_ref.push(4);Вопрос: на что теперь указывает ссылка, которая ссылалась на второй элемент вектора? Разумеется, такая ссылка становится недействительной.

К счастью, Rust является безопасным языком, поэтому компилятор не позволит написать такой код. Выдавая ошибку, он будет руководствоваться правилом безопасности ссылок:

В любом месте кода для любого объекта может существовать либо только одна мутабельная ссылка, либо любое количество немутабельных ссылок.

Также это правило позволяет сделать безопасным использование ссылок в многопоточной среде. Ведь если мы только читаем данные, то это можно делать безопасно из любого количества параллельных потоков. При этом любая операция чтения данных будет потенциально опасной, если существует параллельный поток, который изменяет эти данные.

Чтобы лучше понять как работает контроль ссылок, давайте рассмотрим более простой пример:

fn main() {

let mut s = String::from("x");

let r1 = &mut s; // <-- взятие мутабельной ссылки

let r2 = & s; // <-- попытка взять немутабельную ссылку

println!("{r1}, {r2}");

}Компилятор выдаст ошибку:

4 | let r1 = &mut s; // <-- взятие мутабельной ссылки

| ------ mutable borrow occurs here

5 | let r2 = & s; // <-- попытка взять немутабельную ссылку

| ^^^ immutable borrow occurs here

6 |

7 | println!("{r1}, {r2}");

| -- mutable borrow later used here

Перемещение владения для примитивных типов

Все вышеописанные правила владения данными не относятся к примитивным типам.

Примитивные типы занимают мало памяти и не владеют какими-то дополнительными ресурсами, поэтому в тех ситуациях, где для составных типов происходит передача владения, для примитивных типов просто выполняется копирование.

fn increment(a: i32) -> i32 {

a + 1

}

fn main() {

let x = 5;

let y = increment(x);

println!("x={}, y={}", x, y);

}Цикл for и владение

Еще один интересный момент, который следует рассмотреть — это то, как владение работает при итерировании циклом for.

Рассмотрим пример:

fn main() {

let arr = [String::from("1"), String::from("2"), String::from("3")];

for n in arr {

println!("{n}");

}

println!("{arr:?}");

}Этот пример не скомпилируется, так как в цикле for, на каждом витке итерации следующий элемент массива присваивается переменной n для последующего использования в теле цикла. Присваивание приводит к передаче владения.

В итоге, мы уничтожили массив просто распечатав его.

Эта проблема решается так же просто, как и проблема с передачей аргумента в функцию — путём взятия ссылки.

fn main() {

let arr = [String::from("1"), String::from("2"), String::from("3")];

for n in &arr {

println!("{n}");

}

println!("{arr:?}");

}Теперь когда мы заменили arr на &arr в заголовке цикла, на каждой итерации в переменную n присваивается не очередной элемент массива, а ссылка на него. А значит сам массив не уничтожается.

Note

После этого примера может показаться, что написание программ на Rust превращается в постоянную борьбу с компилятором. На первых порах так оно может и быть. Однако после того как вы привыкнете в концепции владения данными, вы будете на автомате писать так, как надо.

Лайфтаймы

Мы уже знаем, что в Rust каждый объект имеет только одного владельца, но этот владелец может одалживать объект по ссылке в другие участки кода. При этом компилятор проверяет, что время жизни скоупа, одолжившего объект, не больше, чем время жизни владельца этого объекта.

Давайте рассмотрим такой код:

// Функция принимает две ссылки на строки и возвращает ту ссылку,

// которая указывает на более длинную строку.

fn take_longest(x: &str, y: &str) -> &str {

if x.len() > y.len() { x } else { y }

}

fn main() {

let l = take_longest("aaa", "bbbb");

}Попытка скомпилировать этот код провалится с ошибкой:

error[E0106]: missing lifetime specifier

help: this function’s return type contains a borrowed value, but the signature does not say whether it is borrowed from `x` or `y`

help: consider introducing a named lifetime parameter

Эта ошибка говорит, что компилятор не уверен в том, как соотносятся между собой время жизни владельца x, время жизни владельца y и время жизни переменной, в которую будет присвоен результат функции.

Чтобы стало понятнее, давайте взглянем на такой вариант использования функции take_longest:

let s1 = String::from("aaa");

let longest;

{

let s2 = String::from("bbbb");

longest = take_longest(s1.as_str(), s2.as_str());

}Как мы видим, при таком сценарии, ссылка на строку, принадлежащую переменной s2, будет записана в переменную longest. Проблема в том, что переменная longest принадлежит скоупу, который “живёт” дольше, чем скоуп в который входит s2. А как мы сказали выше, компилятор проверяет, что ссылка на объект не “живёт” дольше, чем переменная, владеющая этим объектом.

Для решения этой проблемы необходимо явно указать, как должны соотноситься между собой время жизни владельцев объектов, на которые ссылаются аргументы функции, и время жизни переменной, в которую будет записан результат функции.

Такие отношения времени жизни указывают при помощи лайфтаймов (lifetime).

fn take_longest<'a>(x: &'a str, y: &'a str) -> &'a str {

if x.len() > y.len() { x } else { y }